巨大化するAIと見えなくなる深部:AI Index 2026が突きつける現実

米国スタンフォード大学Human-Centered Artificial Intelligence(HAI)は、AIの研究開発、技術性能、経済、政策、社会受容などを横断的に評価する年次レポート「AI Index 2026」を公開しました。政策担当者、研究者、経営層に向けて、世界で最も広く参照されるAI動向の定量的データ集の一つです。

2026年版は、全9章(研究開発、技術性能、責任あるAI、経済、科学、医療、教育、政策とガバナンス、世論)で構成されています。今年度の最大のトピックは、AIと科学研究の交差を扱う「Science(科学)」章が独立・新設された点です。基礎データの多くは2025年を中心に集計されていますが、モデルの性能評価や社会的な影響など一部の重要指標については2026年初頭、あるいは3月時点の最新動向まで踏み込んで整理されています。

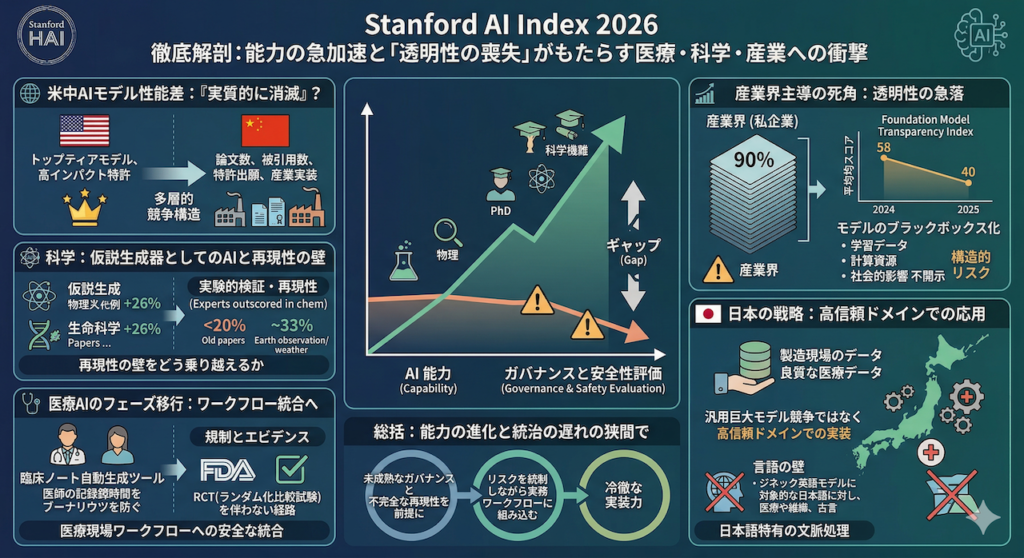

本レポート全体を貫くメッセージは、決して無邪気な技術的熱狂ではありません。むしろ、AIの「能力(Capability)」が博士水準の科学問題や複雑な推論において指数関数的に伸び続ける一方で、その安全性を評価・監視する「統治(Governance)」の仕組みが完全に置き去りにされているという、極めてシビアな現状認識です。

米中のAIモデル性能差は「実質的に消滅」したのか

技術性能と国家間競争の観点において、2026年版レポートは極めて踏み込んだ見解を示しています。それは「米中のAIモデル性能差は実質的に閉じた(effectively closed)」という評価です。

2025年初頭以降、世界最高峰のフロンティアモデルの首位は米国勢と中国勢の間で幾度も入れ替わりながら熾烈な競争を繰り広げてきました。2026年3月時点の特定のベンチマークにおいては、米Anthropic社の最上位モデルがわずか2.7%の差で先行しているものの、もはや米国による「圧倒的な一強状態」は過去のものとなりました。

ただし、この事実は「中国がすべての面で米国を凌駕した」ことを意味するものではありません。レポートは両国の優位性を極めて冷静に切り分けています。米国は、少数のトップティアモデルの開発と、それらを支える高インパクトな特許の創出において依然として優位性を保っています。対する中国は、AI関連の論文数、被引用数、特許の総出願件数、そして産業用ロボットの社会実装数といった「量と実装の面」で圧倒的な存在感を示しています。性能の限界点(フロンティア)では接戦が繰り広げられ、研究の厚みと実社会への導入スケールでは中国が先行するという、多層的な競争構造が浮き彫りになっています。

産業界主導の死角:急落する「透明性」への警鐘

AIの進化における最大の懸念材料として指摘されているのが、モデル開発の不透明化です。2026年版レポートによれば、2025年に世に出た注目すべき最前線モデル(notable frontier models)の90%超を産業界(私企業)が生み出しています。莫大な計算資源とデータを要する最先端AIの開発は、事実上、一部の巨大テック企業に独占されつつあります。

これと並行して深刻化しているのが、企業が提供するモデルのブラックボックス化です。「責任あるAI(Responsible AI)」の章では、AIモデルの透明性を測る「Foundation Model Transparency Index」の平均スコアが、2024年の58から2025年には40へと急落したことが報告されています。

具体的には、モデルの学習にどのようなデータセットが用いられたのか、どの程度の計算資源が投下されたのか、そして社会にデプロイされた後にどのような影響を及ぼしているのかという、検証に不可欠な情報が開示されなくなっています。モデルが強力になり、社会インフラの深部に組み込まれていくのと反比例するように、その中身の検証可能性は失われつつあります。能力の向上と説明責任の低下という、この「逆行する2つのベクトル」こそが、現在のAI産業が抱える最大の構造的リスクです。

論文から実験室へ:科学研究にもたらす「劇的だが不完全な」加速

新設されたScience章では、AIが科学的発見のプロセスに深く入り込んでいる実態がデータで示されました。自然科学分野におけるAI関連論文は2025年に約80,150本に達し、前年比で約26%増加しています。物理科学や生命科学の領域に絞ってもそれぞれ27〜28%の伸びを示しており、研究成果全体に占めるAI関連研究の割合は、分野によって5.8%から8.8%にまで拡大しています。

しかし、スタンフォード大学の研究チームは、この数値を単純な「AIによる科学革命」とは捉えていません。AIが仮説を生成する能力と、それが実際の物理世界で機能するかどうかには、依然として巨大な壁が存在します。

事実、化学分野の特定ベンチマークではAIが人間の専門家の平均スコアを上回る結果を出しているものの、過去の科学論文の内容をAIに再現させるタスクの成功率は20%未満にとどまっています。地球観測や気象モデリングなどの複雑な領域でも再現性は33%程度であり、AIの出力がそのまま「科学的真実」として成立するわけではありません。AIは優れた仮説生成器にはなり得ても、厳密な実験的検証を代替する段階にはなく、この「再現性の壁」をどう乗り越えるかが次なる研究の焦点となっています。

医療AIのフェーズ移行:診断精度から「ワークフロー統合」へ

医療・ヘルスケア産業に関わる実務者にとって、Medicine章の分析は極めて重要な示唆を含んでいます。医療AIの焦点は、単なる「画像診断の精度向上」から、より広範な基礎生物学の解明、バーチャルセルの構築、そして臨床現場におけるオペレーションの変革へと大きくフェーズを移行させています。

特に注目すべき変化は、臨床現場における価値創出です。AIによる臨床ノート(診療録)の自動生成ツールの導入が急速に拡大しており、医師の記録業務にかかる時間を物理的に削減し、バーンアウトを防ぐという明確なROI(投資対効果)が確認され始めています。AIが「医師を代替する」のではなく、「医師の可処分時間を確保するインフラ」として定着しつつある証左と言えます。

一方で、規制とエビデンスの観点では重大な課題も提起されています。FDA(米国食品医薬品局)の承認を取得するAI搭載医療機器(SaMD等)は増加傾向にありますが、その多くが新規のランダム化比較試験(RCT)を伴わない既存の規制経路を利用して市場に投入されています。ソフトウェアの俊敏なイテレーション(改善サイクル)と、厳密な臨床エビデンスの構築という二つの要求をどのように両立させるか。単にモデルを巨大化させることではなく、医療現場のワークフローにいかに安全かつ合法的に統合し、継続的なモニタリング体制を築くかが、今後の医療AIビジネスの勝敗を分ける決定的な要素となります。

日本が向かうべきは「基盤モデル競争」か「高信頼ドメイン実装」か

AI Index 2026が描く世界地図の中で、日本はどのような戦略を描くべきでしょうか。最大の教訓は、もはや「汎用的な巨大基盤モデルの性能競争」だけを追いかけていても勝機は薄い、という現実です。競争の主戦場は、AIを動かすデータセンターの電力確保、半導体の供給網、そして特定の産業ドメインにおける社会実装へと多角化しています。

日本では2025年に「人工知能関連技術の研究開発及び活用の推進に関する法律」が施行され、2026年3月には「AI事業者ガイドライン(第1.2版)」が改訂されるなど、安全安心な社会実装に向けた制度設計が進んでいます。これは、スタンフォード大学が警鐘を鳴らす「能力偏重から統治と実装へのシフト」という世界的潮流と完全に軌を一にしています。

一般目的のAIモデルは産業界の少数のプレイヤーに独占されつつありますが、Science章が示すように、科学や医療に特化した高付加価値なAIは、産学官の協働や公的機関から生まれる傾向があります。日本の勝ち筋は、世界トップレベルの緻密さを持つ製造現場のデータ、国民皆保険制度に支えられた良質な医療データ、そして厳格な社会制度を基盤とした「高信頼ドメインでの応用」にあります。

同時に、言語の壁という構造的な不利も直視しなければなりません。AI Index 2026は、英語中心のベンチマークにおける性能優位と、非英語圏や方言における性能低下を指摘しています。日本の医療現場でAIを安全に稼働させるためには、独特の医療略語、患者との口語的なコミュニケーション、日本語特有の文脈を正確に処理するローカライズが不可欠です。英語圏のモデルをそのまま輸入するだけでは、臨床現場が求める安全性と実用性は担保できません。

総括:能力の進化と統治の遅れの狭間で

AI Index 2026が描き出したのは、技術の進化が社会の適応能力を軽々と追い越していく過渡期の風景です。米中の性能差が縮小し、科学や医療の現場でAIが不可欠なツールとして定着していく一方で、そのアルゴリズムはブラックボックス化し、実世界での安全性評価は後手に回っています。

2026年以降のビジネスや研究開発において求められるのは、「AIがどれだけ賢くなったか」という単一の指標に一喜一憂することではありません。未成熟なガバナンスと不完全な再現性を前提としたうえで、いかに自社のデータと結びつけ、リスクを統制しながら実務のワークフローに組み込んでいくか。その冷徹な「実装力」こそが、真の価値を創出する条件となるはずです。

参考文献

- Stanford University Human-Centered Artificial Intelligence (2026) Artificial Intelligence Index Report 2026.

- 経済産業省 (2026) AI事業者ガイドライン(第1.2版).

ご利用規約(免責事項)

当サイト(以下「本サイト」といいます)をご利用になる前に、本ご利用規約(以下「本規約」といいます)をよくお読みください。本サイトを利用された時点で、利用者は本規約の全ての条項に同意したものとみなします。

第1条(目的と情報の性質)

- 本サイトは、医療分野におけるAI技術に関する一般的な情報提供および技術的な学習機会の提供を唯一の目的とします。

- 本サイトで提供されるすべてのコンテンツ(文章、図表、コード、データセットの紹介等を含みますが、これらに限定されません)は、一般的な学習参考用であり、いかなる場合も医学的な助言、診断、治療、またはこれらに準ずる行為(以下「医行為等」といいます)を提供するものではありません。

- 本サイトのコンテンツは、特定の製品、技術、または治療法の有効性、安全性を保証、推奨、または広告・販売促進するものではありません。紹介する技術には研究開発段階のものが含まれており、その臨床応用には、さらなる研究と国内外の規制当局による正式な承認が別途必要です。

- 本サイトは、情報提供を目的としたものであり、特定の治療法を推奨するものではありません。健康に関するご懸念やご相談は、必ず専門の医療機関にご相談ください。

第2条(法令等の遵守)

利用者は、本サイトの利用にあたり、医師法、医薬品、医療機器等の品質、有効性及び安全性の確保等に関する法律(薬機法)、個人情報の保護に関する法律、医療法、医療広告ガイドライン、その他関連する国内外の全ての法令、条例、規則、および各省庁・学会等が定める最新のガイドライン等を、自らの責任において遵守するものとします。これらの適用判断についても、利用者が自ら関係各所に確認するものとし、本サイトは一切の責任を負いません。

第3条(医療行為における責任)

- 本サイトで紹介するAI技術・手法は、あくまで研究段階の技術的解説であり、実際の臨床現場での診断・治療を代替、補助、または推奨するものでは一切ありません。

- 医行為等に関する最終的な判断、決定、およびそれに伴う一切の責任は、必ず法律上その資格を認められた医療専門家(医師、歯科医師等)が負うものとします。AIによる出力を、資格を有する専門家による独立した検証および判断を経ずに利用することを固く禁じます。

- 本サイトの情報に基づくいかなる行為によって利用者または第三者に損害が生じた場合も、本サイト運営者は一切の責任を負いません。実際の臨床判断に際しては、必ず担当の医療専門家にご相談ください。本サイトの利用によって、利用者と本サイト運営者の間に、医師と患者の関係、またはその他いかなる専門的な関係も成立するものではありません。

第4条(情報の正確性・完全性・有用性)

- 本サイトは、掲載する情報(数値、事例、ソースコード、ライブラリのバージョン等)の正確性、完全性、網羅性、有用性、特定目的への適合性、その他一切の事項について、何ら保証するものではありません。

- 掲載情報は執筆時点のものであり、予告なく変更または削除されることがあります。また、技術の進展、ライブラリの更新等により、情報は古くなる可能性があります。利用者は、必ず自身で公式ドキュメント等の最新情報を確認し、自らの責任で情報を利用するものとします。

第5条(AI生成コンテンツに関する注意事項)

本サイトのコンテンツには、AIによる提案を基に作成された部分が含まれる場合がありますが、公開にあたっては人間による監修・編集を経ています。利用者が生成AI等を用いる際は、ハルシネーション(事実に基づかない情報の生成)やバイアスのリスクが内在することを十分に理解し、その出力を鵜呑みにすることなく、必ず専門家による検証を行うものとします。

第6条(知的財産権)

- 本サイトを構成するすべてのコンテンツに関する著作権、商標権、その他一切の知的財産権は、本サイト運営者または正当な権利を有する第三者に帰属します。

- 本サイトのコンテンツを引用、転載、複製、改変、その他の二次利用を行う場合は、著作権法その他関連法規を遵守し、必ず出典を明記するとともに、権利者の許諾を得るなど、適切な手続きを自らの責任で行うものとします。

第7条(プライバシー・倫理)

本サイトで紹介または言及されるデータセット等を利用する場合、利用者は当該データセットに付随するライセンス条件および研究倫理指針を厳格に遵守し、個人情報の匿名化や同意取得の確認など、適用される法規制に基づき必要とされるすべての措置を、自らの責任において講じるものとします。

第8条(利用環境)

本サイトで紹介するソースコードやライブラリは、執筆時点で特定のバージョンおよび実行環境(OS、ハードウェア、依存パッケージ等)を前提としています。利用者の環境における動作を保証するものではなく、互換性の問題等に起因するいかなる不利益・損害についても、本サイト運営者は責任を負いません。

第9条(免責事項)

- 本サイト運営者は、利用者が本サイトを利用したこと、または利用できなかったことによって生じる一切の損害(直接損害、間接損害、付随的損害、特別損害、懲罰的損害、逸失利益、データの消失、プログラムの毀損等を含みますが、これらに限定されません)について、その原因の如何を問わず、一切の法的責任を負わないものとします。

- 本サイトの利用は、学習および研究目的に限定されるものとし、それ以外の目的での利用はご遠慮ください。

- 本サイトの利用に関連して、利用者と第三者との間で紛争が生じた場合、利用者は自らの費用と責任においてこれを解決するものとし、本サイト運営者に一切の迷惑または損害を与えないものとします。

- 本サイト運営者は、いつでも予告なく本サイトの運営を中断、中止、または内容を変更できるものとし、これによって利用者に生じたいかなる損害についても責任を負いません。

第10条(規約の変更)

本サイト運営者は、必要と判断した場合、利用者の承諾を得ることなく、いつでも本規約を変更することができます。変更後の規約は、本サイト上に掲載された時点で効力を生じるものとし、利用者は変更後の規約に拘束されるものとします。

第11条(準拠法および合意管轄)

本規約の解釈にあたっては、日本法を準拠法とします。本サイトの利用および本規約に関連して生じる一切の紛争については、東京地方裁判所を第一審の専属的合意管轄裁判所とします。

For J³, may joy follow you.