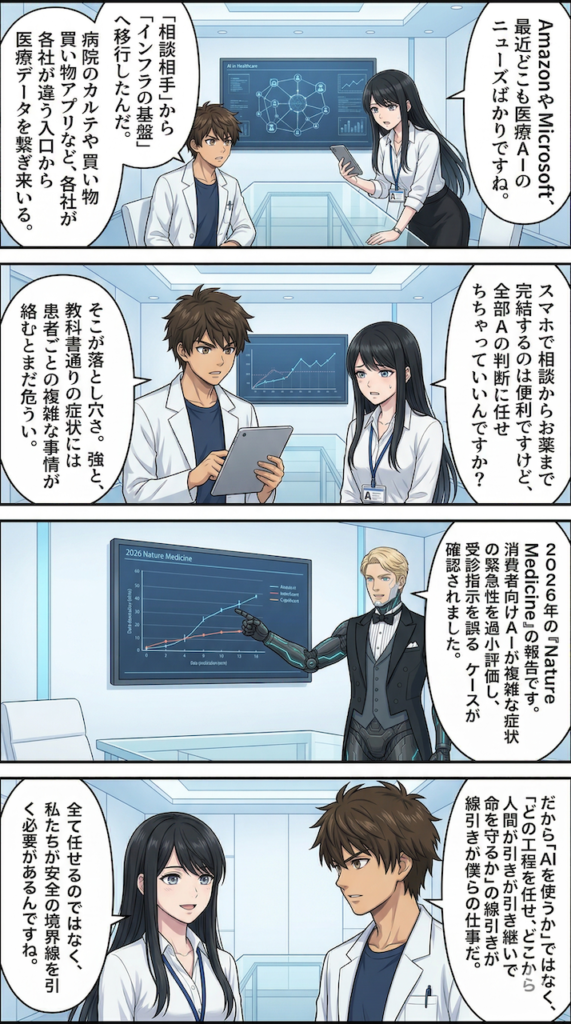

「相談相手」から「医療インフラの接続基盤」へ

今月、Microsoft、Amazon、そしてOpenAIという3つの巨大企業が、それぞれ異なるアプローチで「医療向けプラットフォーム」に関する最新の展開を示しました。

これまで医療AIといえば、「症状を入力して参考情報を得る」といった独立した機能として注目されてきました。しかし、2026年現在の動きは、病院の電子カルテ(EHR)の裏側や、私たちが日常的に使うアプリケーションの内部へと、AIが統合されつつあることを意味しています。

つまり各社が構築しようとしているのは、会話ができるチャットボットという単一のツールではなく、医療データの流れ全体に影響を及ぼす「次世代のデジタルインフラ」だと言えます。本記事では、最新動向から各社の具体的な戦略の違い、そして見過ごされがちな「実臨床におけるリスク」までを整理します。

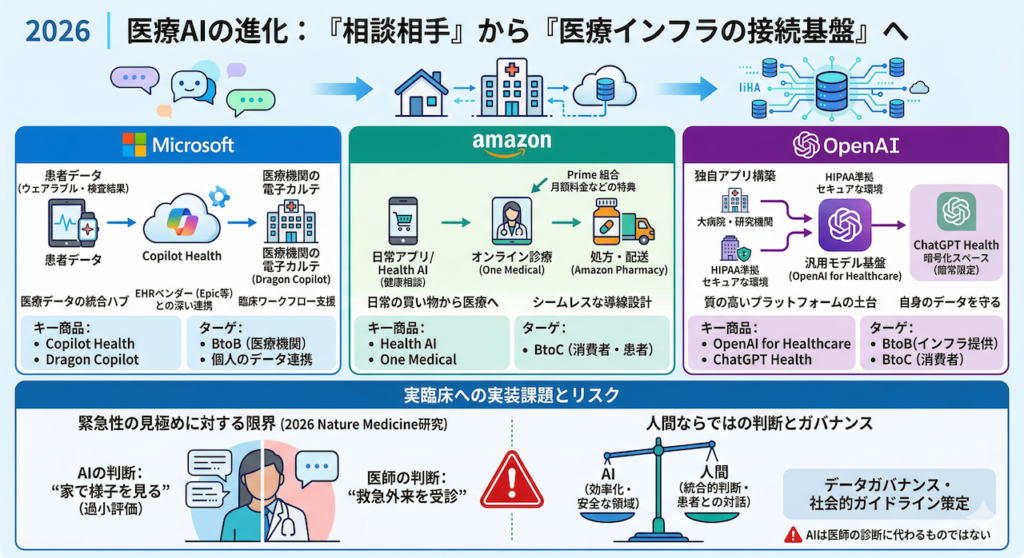

3社のプラットフォーム構造とターゲット比較

各社の最新の動きを俯瞰するために、それぞれの主力となる領域とシステム構造の違いを整理してみましょう。

| 企業名 | 主要プロダクト | ターゲット層 | コア領域と具体的な連携 |

|---|---|---|---|

| Microsoft | Copilot Health Dragon Copilot | BtoB(医療機関) および個人のデータ連携 | 既存の電子カルテ(Epic等)との深い連携。 医療機関のデータとウェアラブル規模の統合を目指す。 |

| Amazon | Health AI One Medical | BtoC(消費者・患者) | 「買い物アプリ」から直接受診・服薬へつながる導線設計。 Prime会員向けに月額9ドルなどの特典を展開。 |

| OpenAI | OpenAI for Healthcare ChatGPT Health | BtoB(インフラ提供) およびBtoC | 最新の言語モデル提供とHIPAA準拠のセキュリティ。 自社でセキュアなAIを構築したい大組織に向けた基盤。 |

Microsoft:電子カルテと連携し、情報の流れを橋渡しする

Microsoftが3月の「HIMSS 2026」カンファレンスで示した方針は、医療現場のシステム基盤を安全に連携させるためのハブとなることです。長年培ってきたBtoBの信頼を背景に、医療ITシステムの中心部で機能拡張を図っています。

適切な同意のもとに健康データを統合する「Copilot Health」

一般向けの大規模な試みとして発表された「Copilot Health」(米国等で展開)は、利用者の明確な同意とセキュリティ管理のもとで、ウェアラブル機器のデータや提携する医療機関からの患者データ(検査結果や病歴)を統合する仕組みです(MLQ.ai 2026)。ISO/IEC 42001などの国際的なAI要件を意識しながら、個人情報の保護と利便性の両立を目指しています。

EHR(電子カルテ)と共存する「Dragon Copilot」

さらに注目されるのが、医療従事者向けAI「Dragon Copilot」の展開です。大手電子カルテベンダー「Epic」などとの提携により、単なる音声入力にとどまらず、診療記録の生成やコーディング支援など、臨床現場のワークフローに沿った機能を提供しています(Fierce Healthcare 2026)。また、サードパーティの特化型アプリを統合的に利用できる拡張性も持たせており、乱立する医療ITシステムを1つの窓口で利用できるようにする取り組みが進められています。

Amazon:日常のアプリから「受診と薬」をシームレスにつなぐ

Microsoftが医療機関のシステム側から入るのに対し、Amazonは「個人の日常的な行動導線」から医療分野への接続を図っています。

Prime会員とOne Medicalの連携

Amazonが買収したハイブリッド診療サービス「One Medical」を通じ、米国のPrime会員は年間99ドル(または月額9ドル)の割引料金でメンバーシップを利用できます。さらに最近では、Prime会員特典の一環として、アレルギーや尿路感染症などの一般的な軽症疾患に対して、One Medicalの医師とのメッセージ相談を条件付き(一定回数まで無料など)で提供する動きも見られます(Fierce Healthcare 2026; Digital Commerce 360 2026)。

相談から処方までをひとつの体験に

例えば、日ごろ使っているAmazonのアプリやウェブサイト上で、AIサポート機能(Health AI)を通じて健康に関する一般的な相談を行い、必要に応じてそのままOne Medicalの診療へ移行。そこで処方された薬は「Amazon Pharmacy」によって自宅へ配送されるといった、一連の流れが整備されつつあります(PC Mag 2026)。買い物の延長線上に医療の入り口を置くことで、サービスへのアクセス障壁を下げる狙いがあります。

OpenAI:「基盤」の提供と、消費者向けの暗号化スペース

生成AI技術を牽引してきたOpenAIは、システム全体の囲い込みというよりも、「質の高いプラットフォームの土台」を提供する役割と、消費者向けのAIインターフェースとしての顔を使い分けています。

HIPAA対応の「OpenAI for Healthcare」

企業や病院向けの「OpenAI for Healthcare」は、最新の大規模言語モデル(具体的なバージョンは公開情報や契約により異なる)を搭載したエンタープライズ向けの基盤です。顧客の入力データを事前学習に流用しないよう設計され、米国のHIPAA(医療情報保護の法律)に準拠したセキュアな環境を提供するためのBAA(ビジネスアソシエイト契約)にも対応しています(ALM Corp 2026)。これにより、大病院や研究機関が「自身のデータを守りながら独自のAIアプリを作る」ことが可能になっています。

消費者に向けた「ChatGPT Health」

一方で一般ユーザーに対しては、ChatGPTのなかに専用の暗号化スペース「ChatGPT Health」を設けています。ここでは健康記録との連携なども模索されていますが、利用に際しては「これは情報提供であり、診断行為ではない」と明確な線引きが行われています。利用者数についてはさまざまな推計(数千万人規模との公表データ等)がありますが、いずれにせよ非常に多くの人が日常的な健康情報の検索に利用している実態がうかがえます(Mount Sinai 2026)。

ただの「熱狂」では済まされない、実臨床への実装課題

こうした技術のプラットフォーム化は利便性をもたらす一方で、実臨床に当てはめるうえでは慎重に評価すべき壁が存在します。AIのシステムがどのように機能するか、最新の研究から一部のリスクが指摘されています。

緊急性の見極めに対する現在の限界

2026年に学術誌『Nature Medicine』で報告された研究では、消費者向けの医療AIツール(ChatGPT Healthなど)の安全性評価が行われました。その結果、一部のケースにおいて、医師であれば「すぐに救急外来を受診すべき」と判断するような医学的な緊急事態(複雑な文脈を含む症状など)に対し、緊急性の評価が不十分となり、「家で様子を見るように」といった過小評価の助言を出してしまう傾向があることが指摘されています(Mount Sinai 2026)。

教科書通りの明確な症状には適切に反応できても、患者個別の事情が絡むグレーゾーンの判断においては、AIの推論を完全に信頼するには至っていません。自殺兆候のような心理的危機のセーフガードについても、期待通りに作動しない事例が報告されています。

私たちが冷静に見極めるべきこと

各社が一様に「AIは医師の診断に代わるものではない」と免責事項を入れているのは、技術の限界がそこにあるからです。また、個人の機微な健康記録をどのように管理・同意取得のうえで統合していくかというデータガバナンスの問題についても、社会的なガイドライン作りと並行して議論を進めていく必要があります。

これからの医療現場に必要な視点

「このAIを導入するかどうか」という単発の議論を超え、現在は「新しく構築されるデジタルプラットフォーム上で、どのように安全な医療を設計するか」が問われるフェーズに入っています。

医療従事者やヘルスケア事業者は、テクノロジーの性能を過信・軽視するのではなく、「AIに委ねることで業務が効率化され、かつ安全が確保できる領域はどこか」「専門職である人間ならではの統合的な判断や、患者との対話が必要な領域はどこか」を冷静に線引きし、日々のプロセスを再構築していくことが求められています。

参考文献

- Amazon One Medical Official Care Policies.

- ALM Corp. (2026) ‘OpenAI for Healthcare introduces rigorous HIPAA compliance for models’.

- Digital Commerce 360 (2026) ‘Amazon Health AI and One Medical integration overview’.

- FDA (2023) Marketing Submission Recommendations for a Predetermined Change Control Plan for Artificial Intelligence/Machine Learning (AI/ML)-Enabled Device Software Functions.

- Fierce Healthcare (2026) ‘Amazon rolls out AI health assistant options to Prime members’.

- Fierce Healthcare (2026) ‘Microsoft deepens Epic partnership with Dragon Copilot features at HIMSS 2026’.

- HIT Consultant (2026) ‘Microsoft Unveils Dragon Copilot Enhancements’.

- Microsoft Health AI Official Documentation regarding Copilot Health.

- MLQ.ai (2026) ‘Microsoft Copilot Health integrations’.

- Mount Sinai Health System. (2026) ‘Researchers Evaluate “ChatGPT Health” in Medical Emergencies’, referencing findings published in Nature Medicine.

- OpenAI Technical Reports and Healthcare Policies.

- Rajkomar, A. et al. (2018) ‘Scalable deep learning for electronic health records’, NPJ Digital Medicine.

- Topol, E. (2019) Deep Medicine: How Artificial Intelligence Can Make Healthcare Human Again.

- WHO (2021) Ethics and governance of artificial intelligence for health.

ご利用規約(免責事項)

当サイト(以下「本サイト」といいます)をご利用になる前に、本ご利用規約(以下「本規約」といいます)をよくお読みください。本サイトを利用された時点で、利用者は本規約の全ての条項に同意したものとみなします。

第1条(目的と情報の性質)

- 本サイトは、医療分野におけるAI技術に関する一般的な情報提供および技術的な学習機会の提供を唯一の目的とします。

- 本サイトで提供されるすべてのコンテンツ(文章、図表、コード、データセットの紹介等を含みますが、これらに限定されません)は、一般的な学習参考用であり、いかなる場合も医学的な助言、診断、治療、またはこれらに準ずる行為(以下「医行為等」といいます)を提供するものではありません。

- 本サイトのコンテンツは、特定の製品、技術、または治療法の有効性、安全性を保証、推奨、または広告・販売促進するものではありません。紹介する技術には研究開発段階のものが含まれており、その臨床応用には、さらなる研究と国内外の規制当局による正式な承認が別途必要です。

- 本サイトは、情報提供を目的としたものであり、特定の治療法を推奨するものではありません。健康に関するご懸念やご相談は、必ず専門の医療機関にご相談ください。

第2条(法令等の遵守)

利用者は、本サイトの利用にあたり、医師法、医薬品、医療機器等の品質、有効性及び安全性の確保等に関する法律(薬機法)、個人情報の保護に関する法律、医療法、医療広告ガイドライン、その他関連する国内外の全ての法令、条例、規則、および各省庁・学会等が定める最新のガイドライン等を、自らの責任において遵守するものとします。これらの適用判断についても、利用者が自ら関係各所に確認するものとし、本サイトは一切の責任を負いません。

第3条(医療行為における責任)

- 本サイトで紹介するAI技術・手法は、あくまで研究段階の技術的解説であり、実際の臨床現場での診断・治療を代替、補助、または推奨するものでは一切ありません。

- 医行為等に関する最終的な判断、決定、およびそれに伴う一切の責任は、必ず法律上その資格を認められた医療専門家(医師、歯科医師等)が負うものとします。AIによる出力を、資格を有する専門家による独立した検証および判断を経ずに利用することを固く禁じます。

- 本サイトの情報に基づくいかなる行為によって利用者または第三者に損害が生じた場合も、本サイト運営者は一切の責任を負いません。実際の臨床判断に際しては、必ず担当の医療専門家にご相談ください。本サイトの利用によって、利用者と本サイト運営者の間に、医師と患者の関係、またはその他いかなる専門的な関係も成立するものではありません。

第4条(情報の正確性・完全性・有用性)

- 本サイトは、掲載する情報(数値、事例、ソースコード、ライブラリのバージョン等)の正確性、完全性、網羅性、有用性、特定目的への適合性、その他一切の事項について、何ら保証するものではありません。

- 掲載情報は執筆時点のものであり、予告なく変更または削除されることがあります。また、技術の進展、ライブラリの更新等により、情報は古くなる可能性があります。利用者は、必ず自身で公式ドキュメント等の最新情報を確認し、自らの責任で情報を利用するものとします。

第5条(AI生成コンテンツに関する注意事項)

本サイトのコンテンツには、AIによる提案を基に作成された部分が含まれる場合がありますが、公開にあたっては人間による監修・編集を経ています。利用者が生成AI等を用いる際は、ハルシネーション(事実に基づかない情報の生成)やバイアスのリスクが内在することを十分に理解し、その出力を鵜呑みにすることなく、必ず専門家による検証を行うものとします。

第6条(知的財産権)

- 本サイトを構成するすべてのコンテンツに関する著作権、商標権、その他一切の知的財産権は、本サイト運営者または正当な権利を有する第三者に帰属します。

- 本サイトのコンテンツを引用、転載、複製、改変、その他の二次利用を行う場合は、著作権法その他関連法規を遵守し、必ず出典を明記するとともに、権利者の許諾を得るなど、適切な手続きを自らの責任で行うものとします。

第7条(プライバシー・倫理)

本サイトで紹介または言及されるデータセット等を利用する場合、利用者は当該データセットに付随するライセンス条件および研究倫理指針を厳格に遵守し、個人情報の匿名化や同意取得の確認など、適用される法規制に基づき必要とされるすべての措置を、自らの責任において講じるものとします。

第8条(利用環境)

本サイトで紹介するソースコードやライブラリは、執筆時点で特定のバージョンおよび実行環境(OS、ハードウェア、依存パッケージ等)を前提としています。利用者の環境における動作を保証するものではなく、互換性の問題等に起因するいかなる不利益・損害についても、本サイト運営者は責任を負いません。

第9条(免責事項)

- 本サイト運営者は、利用者が本サイトを利用したこと、または利用できなかったことによって生じる一切の損害(直接損害、間接損害、付随的損害、特別損害、懲罰的損害、逸失利益、データの消失、プログラムの毀損等を含みますが、これらに限定されません)について、その原因の如何を問わず、一切の法的責任を負わないものとします。

- 本サイトの利用は、学習および研究目的に限定されるものとし、それ以外の目的での利用はご遠慮ください。

- 本サイトの利用に関連して、利用者と第三者との間で紛争が生じた場合、利用者は自らの費用と責任においてこれを解決するものとし、本サイト運営者に一切の迷惑または損害を与えないものとします。

- 本サイト運営者は、いつでも予告なく本サイトの運営を中断、中止、または内容を変更できるものとし、これによって利用者に生じたいかなる損害についても責任を負いません。

第10条(規約の変更)

本サイト運営者は、必要と判断した場合、利用者の承諾を得ることなく、いつでも本規約を変更することができます。変更後の規約は、本サイト上に掲載された時点で効力を生じるものとし、利用者は変更後の規約に拘束されるものとします。

第11条(準拠法および合意管轄)

本規約の解釈にあたっては、日本法を準拠法とします。本サイトの利用および本規約に関連して生じる一切の紛争については、東京地方裁判所を第一審の専属的合意管轄裁判所とします。

For J³, may joy follow you.

- Amazon One Medical Official Care Policies.

- ALM Corp. (2026) ‘OpenAI for Healthcare introduces rigorous HIPAA compliance for models’.

- Digital Commerce 360 (2026) ‘Amazon Health AI and One Medical integration overview’.

- FDA (2023) Marketing Submission Recommendations for a Predetermined Change Control Plan for Artificial Intelligence/Machine Learning (AI/ML)-Enabled Device Software Functions.

- Fierce Healthcare (2026) ‘Amazon rolls out AI health assistant options to Prime members’.

- Fierce Healthcare (2026) ‘Microsoft deepens Epic partnership with Dragon Copilot features at HIMSS 2026’.

- HIT Consultant (2026) ‘Microsoft Unveils Dragon Copilot Enhancements’.

- Microsoft Health AI Official Documentation regarding Copilot Health.

- MLQ.ai (2026) ‘Microsoft Copilot Health integrations’.

- Mount Sinai Health System. (2026) ‘Researchers Evaluate “ChatGPT Health” in Medical Emergencies’, referencing findings published in Nature Medicine.

- OpenAI Technical Reports and Healthcare Policies.

- Rajkomar, A. et al. (2018) ‘Scalable deep learning for electronic health records’, NPJ Digital Medicine.

- Topol, E. (2019) Deep Medicine: How Artificial Intelligence Can Make Healthcare Human Again.

- WHO (2021) Ethics and governance of artificial intelligence for health.

※本記事は一般的なテクノロジーの動向に関する情報提供を目的としたものであり、特定の医薬品、医療機器、治療法を推奨するものではありません。健康に関するご懸念やご相談は、必ず専門の医療機関にご相談ください。