🧑⚕️ CLOCKWORK HIPPOCRATES|TECHNICAL FILES 🤖

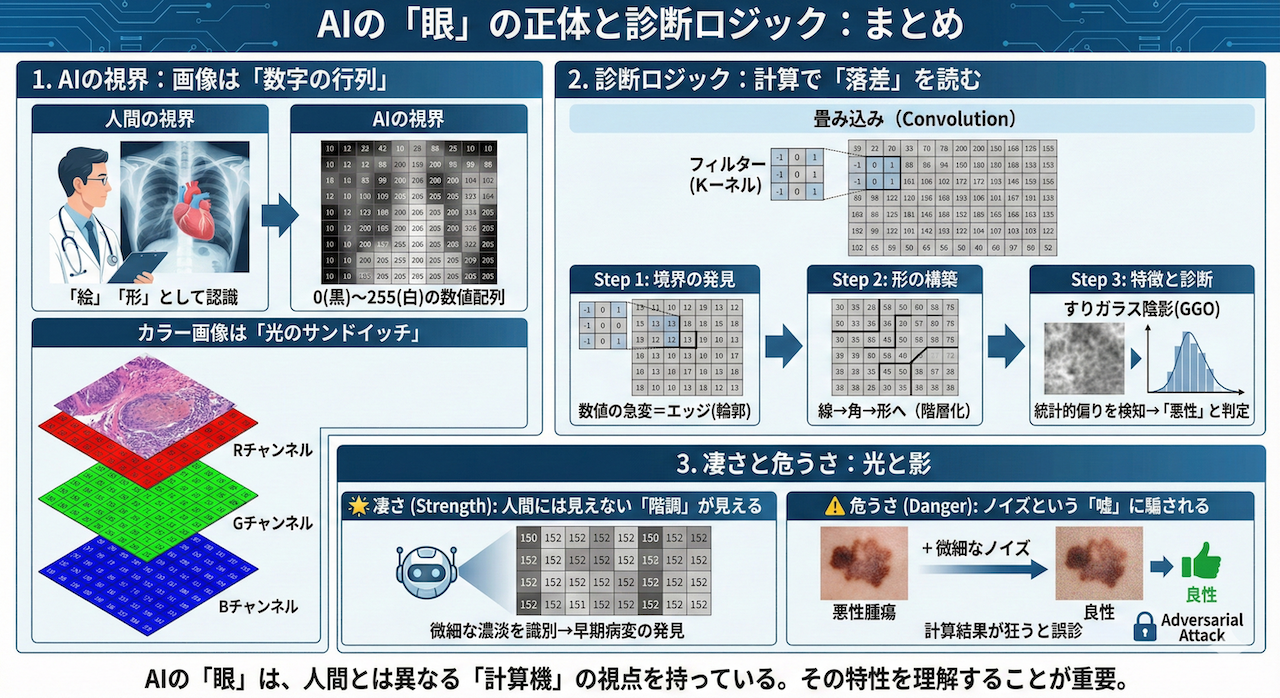

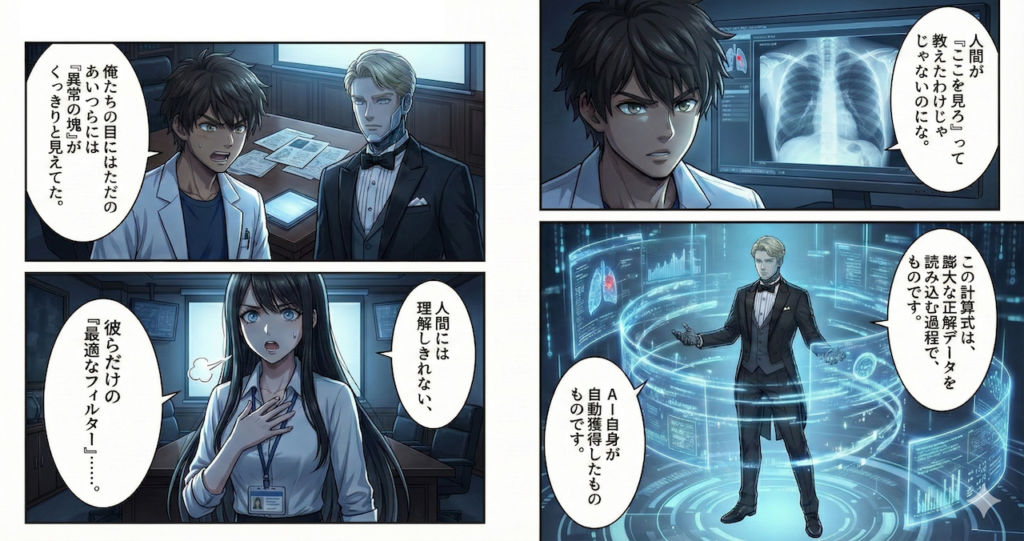

– AIの『眼』の正体と診断ロジック –

(操作:右で進む・左で戻る)

※ 読み込みに時間がかかります。

※ AIで画像生成しているため、文字化けがあります。ご了承ください。

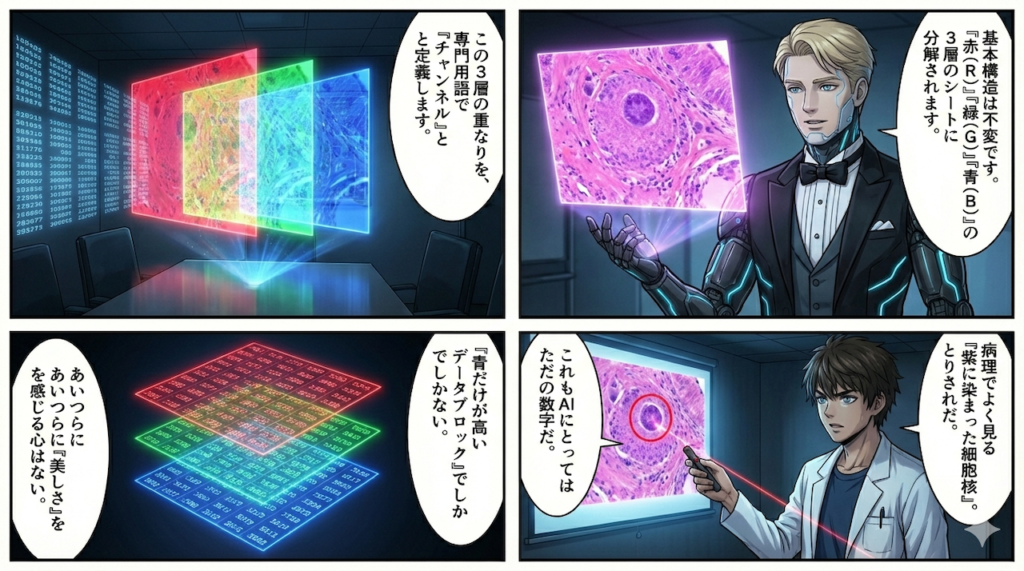

AIは画像を「絵」としてではなく、0〜255の数値が並ぶ巨大なエクセルシート(行列)として認識します。

人間の感覚とは根本的に異なるその仕組み、圧倒的な強み、そして特有の弱点をまとめました。

AIにとって画像は、0(黒)〜255(白)の整数が並んだ行列データに過ぎません。カラー画像はRGB(赤・緑・青)の3枚のシートが重なったものです。AIは「形」を見るのではなく、「数値の配列パターン」を計算処理しています。

AIは小さな計算窓(フィルター)をスライドさせ、数値が急激に変わる場所(=エッジ/輪郭)を検出します。この処理を何層も重ねることで、線 → 形 → テクスチャと、脳の視覚野と同じように特徴を組み立てて診断します。

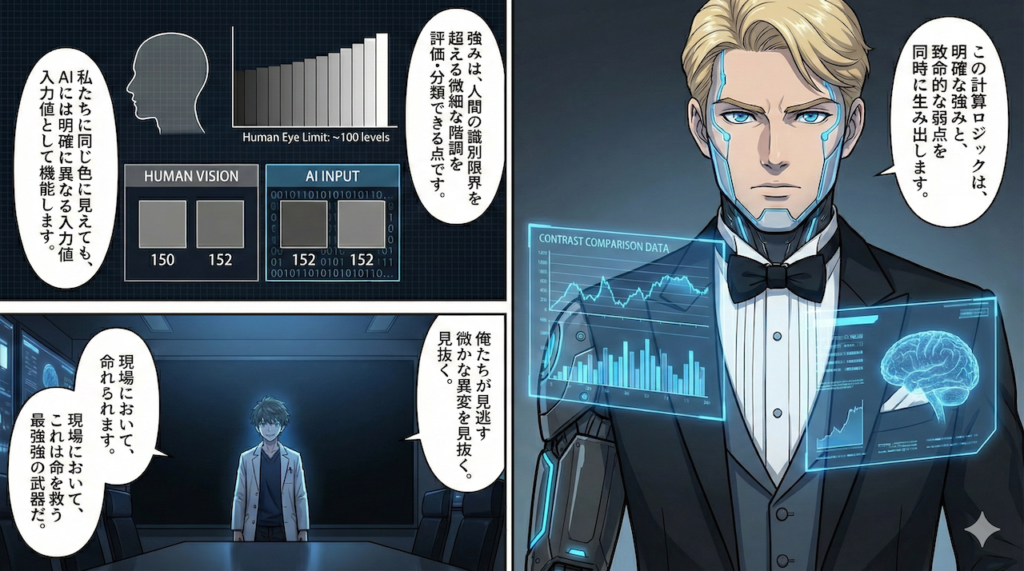

強み:人間には見えない微細な濃度差(階調)を識別でき、早期病変の発見に寄与します。

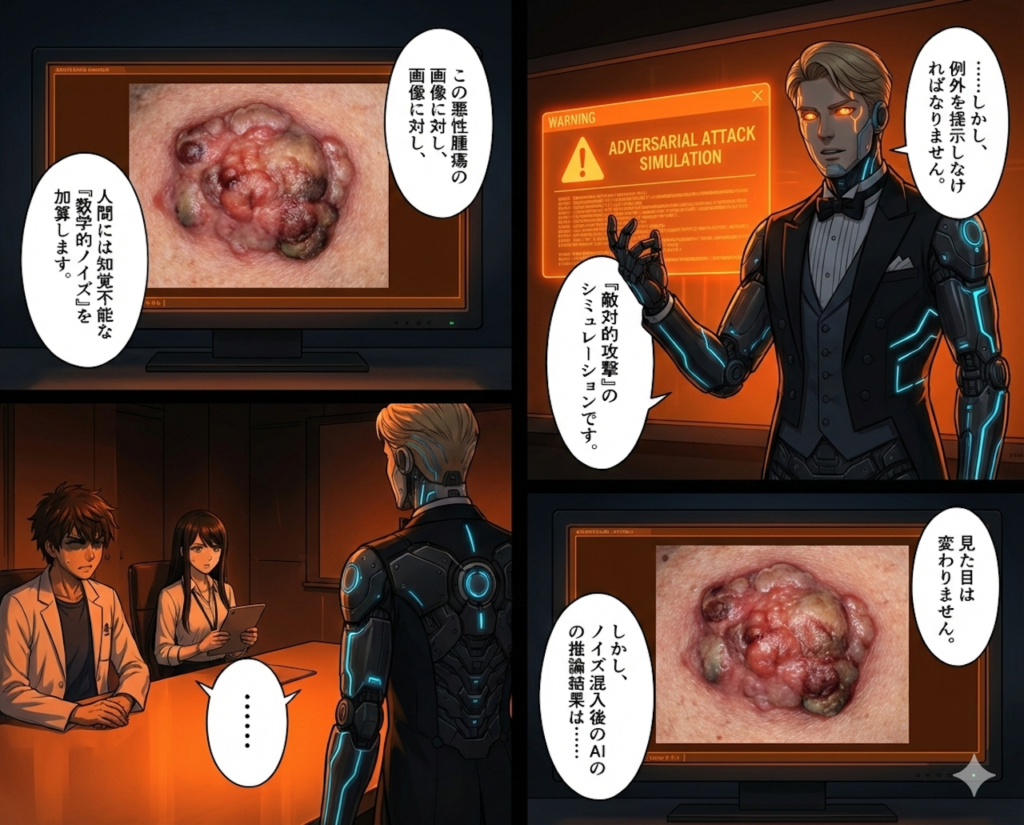

弱点:意味ではなく計算結果で見ているため、目に見えないノイズ(Adversarial Attack)が入ると、計算が狂い誤診するリスクがあります。

「AIは、レントゲン写真をどうやって見ているのでしょうか?」

これは、これから医療AIを学ぼうとする先生方が最初にぶつかる、そして最も大きな「感覚の壁」です。

私たちは胸部X線画像を見たとき、そこに「白い影」があれば肺炎を疑い、「心陰影の拡大」があれば心不全を疑います。つまり、私たちは画像から「意味(病態)」を直接読み取っています。

しかし、ここで重要な事実をお伝えしなければなりません。

AIは、「心臓」や「肺」といった臓器そのものを、人間と同じような意味づけで見ているわけではありません。

さらに言えば、AIにとって「画像」は美しい写真やレントゲン像ではなく、あとで説明するような「数字が並んだデータの表」に過ぎません。

「じゃあ、AIはいったい何を診断しているんだ?」

その答えを一言で言えば、「巨大なエクセルシート(数字の羅列)」です。

今回は、長年培ってきた人間の「視覚」という感覚を一旦捨てていただきます。そして、コンピュータだけが持っている「冷徹な計算機の目」をインストールしていただきます。

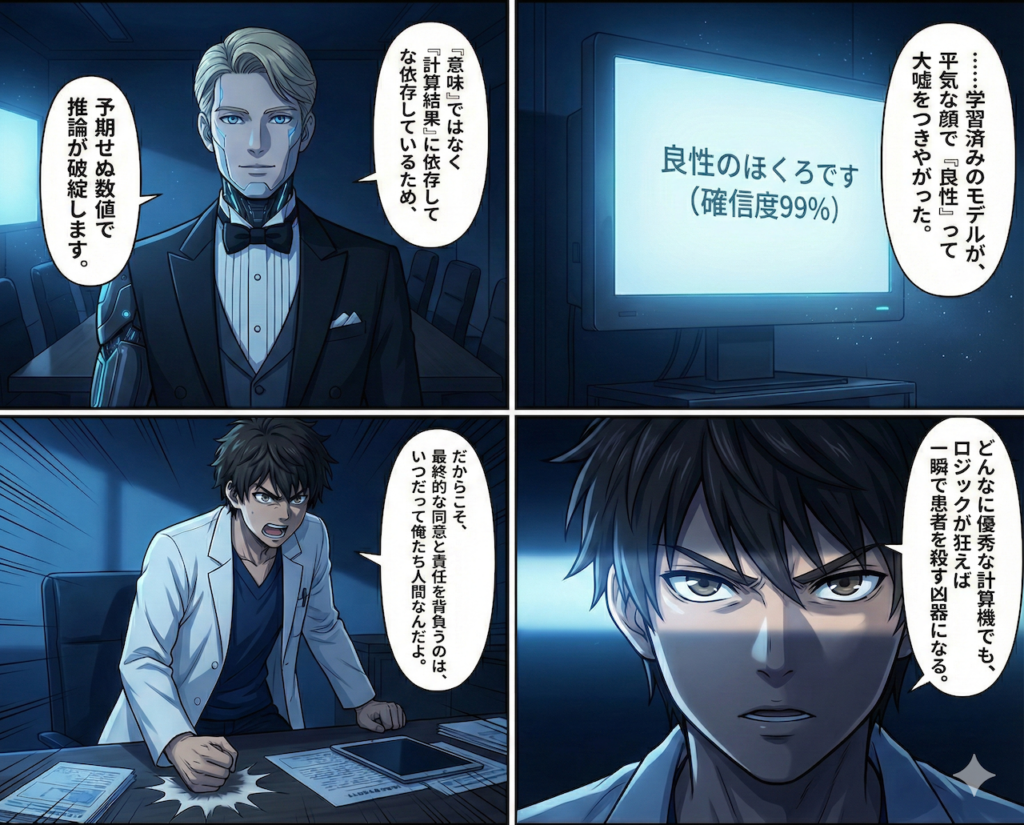

この感覚さえ掴んでしまえば、AIがなぜ人間には見えない微細な特徴を見つけられる可能性があるのか、逆になぜ簡単なノイズに騙されてしまうことがあるのか、その理由が解けるようになります。

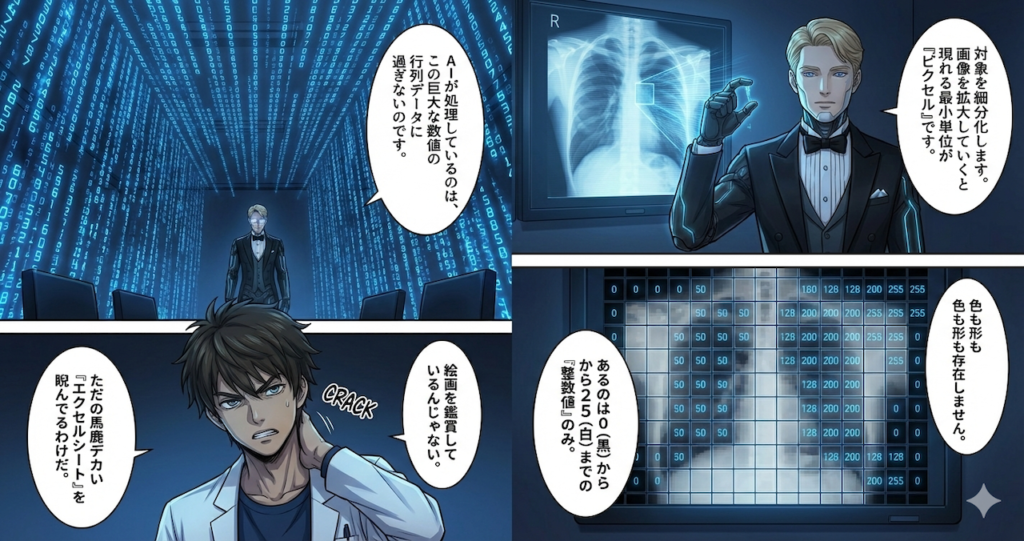

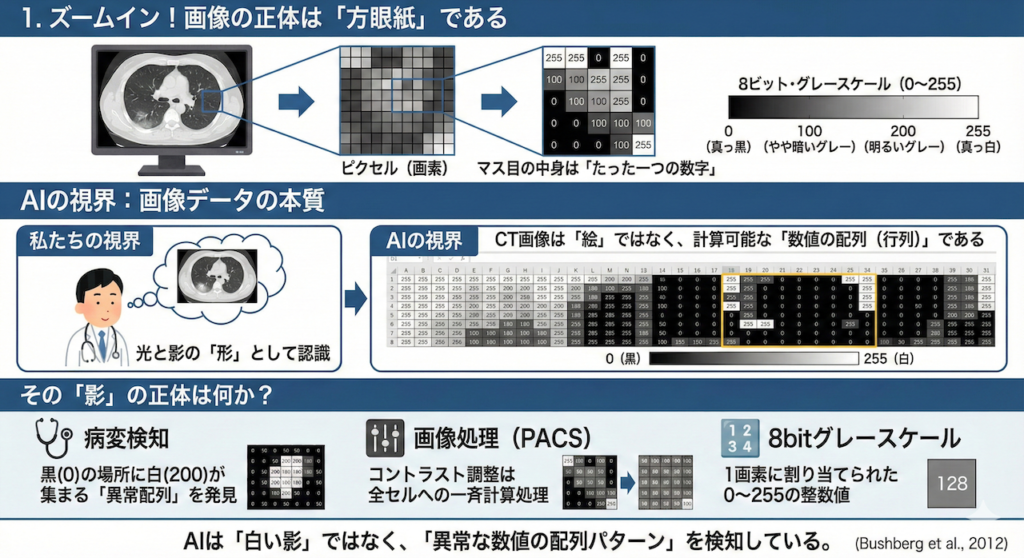

1. ズームイン!画像の正体は「方眼紙」である

まずは、一枚のCT画像を想像してください。モニター上でその画像を限界まで拡大していくと、どうなるでしょうか?

最後には、小さな四角いマス目がたくさん並んだ、モザイク画のような状態になりますよね。このマス目一つひとつのことを「ピクセル(画素)」と呼びます。

ここまではご存知の方も多いでしょう。では、その「マス目の中」には何が入っているのでしょうか?色でしょうか?インクでしょうか?

いいえ、コンピュータにとって、そこに入っているのは「たった一つの数字」だけです。

ここでは話をわかりやすくするために、説明用として「8ビット・グレースケール」の例を使います。この場合、各マス目には「0」から「255」までの整数が割り振られます。

実際のCTなど一部のモダリティでは、より多くのビット数(12〜16ビット程度)が使われ、さらに細かい階調を扱えることもありますが、基本的な考え方は同じです。

- 0 : 光が全くない状態(真っ黒)

- 255 : 光が最大の状態(真っ白)

- 100 : やや暗いグレー

- 200 : 明るいグレー

つまり、私たちが「鮮明なレントゲン写真」だと信じているものは、AIの目を通すと、次のような「数字がびっしりと書き込まれた巨大なエクセルシート(行列)」に見えているのです。

例えば、AIが「肺炎」を見つけるとき、それは「白い影」を見ているのではありません。

「本来は『0(黒)』や『50(暗いグレー)』が並んでいるはずのエリアに、『200(白)』や『180』といった高い数字が集まっている異常な配列パターン」を検知しているのです。

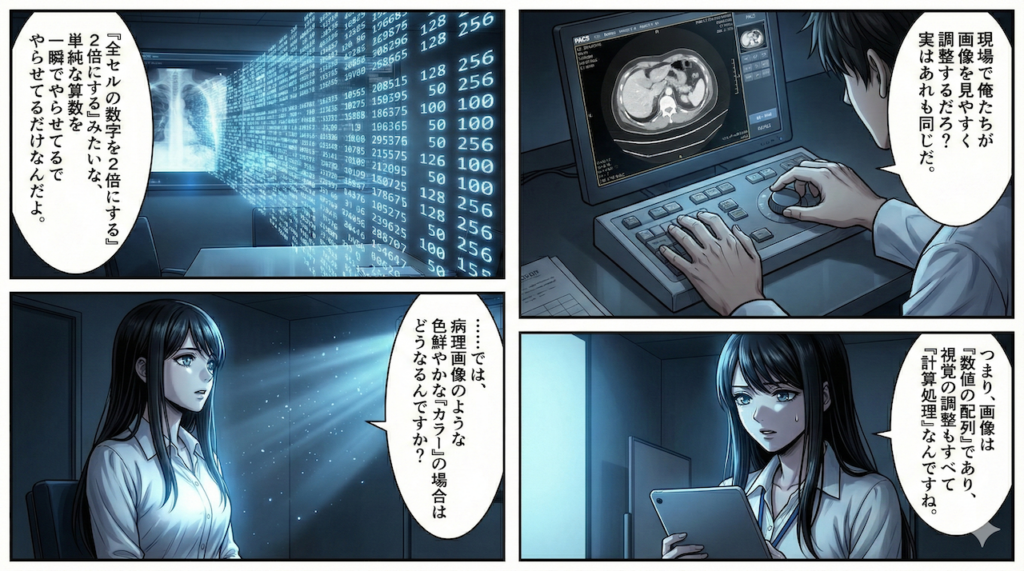

PACS(医療画像管理システム)で画像のコントラスト(ウィンドウレベル)を調整するとき、私たちは「見やすくしている」と感じます。しかし、コンピュータの中で起きているのは、単なる算数です。

「全てのセルの数字を2倍にする(明るくする)」「100以下の数字を全部0にする(メリハリをつける)」といった計算処理が、一瞬で全マス目に対して行われているだけなのです (Bushberg et al., 2012)。

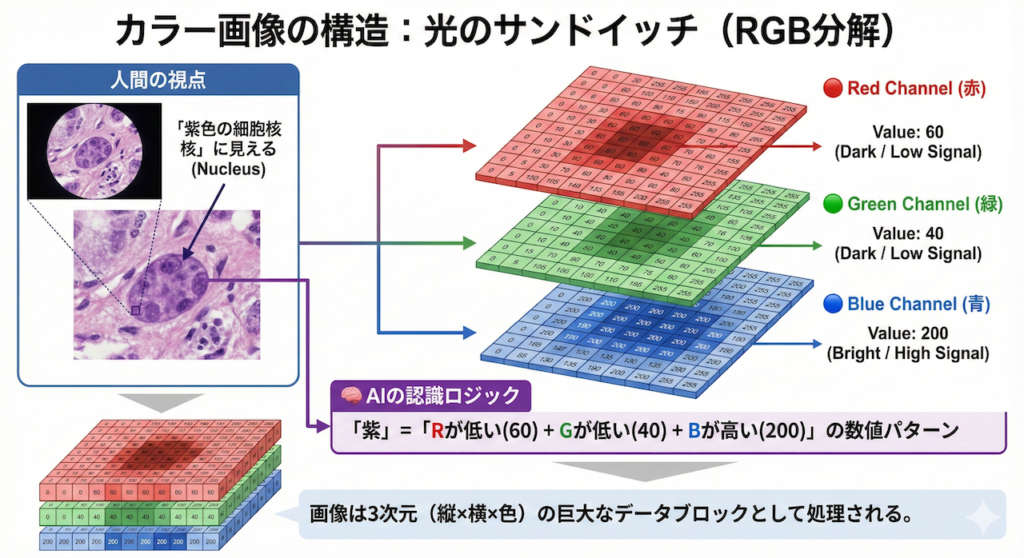

2. カラー画像は「光のサンドイッチ」

「白黒画像はわかった。でも、皮膚科のダーモスコピーや病理のH&E染色はカラーじゃないか。あれはどうなっているんだ?」

鋭い質問です。実は、カラー画像も原理は全く同じです。

カラー画像は、「赤(Red)」「緑(Green)」「青(Blue)」という、光の三原色に対応した3枚のエクセルシートが重なったサンドイッチ構造になっています。これを専門用語で「チャンネル(Channel)」と呼びます。

例えば、病理画像で「ヘマトキシリンで青紫に染まった細胞核」をAIが見るとき、AIは「紫色」という色を感じてはいません。

このように、AIは一枚のカラー画像を「赤・緑・青の3枚のエクセルシート」に分解し、それぞれの数字の組み合わせとして色を扱っています。人間が「紫がかった核」と感じる部分も、AIにとっては「Rが低く、Gも低く、Bだけが高い」という数値パターンに過ぎません。

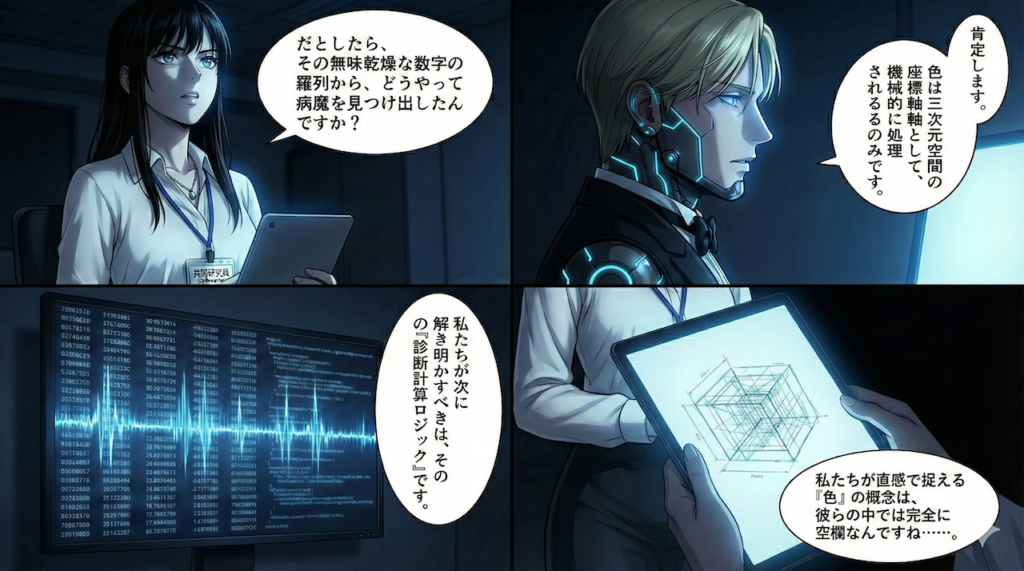

AIにとって画像とは、縦・横・色の3次元に広がる、ただの巨大なデータの塊に過ぎないのです。

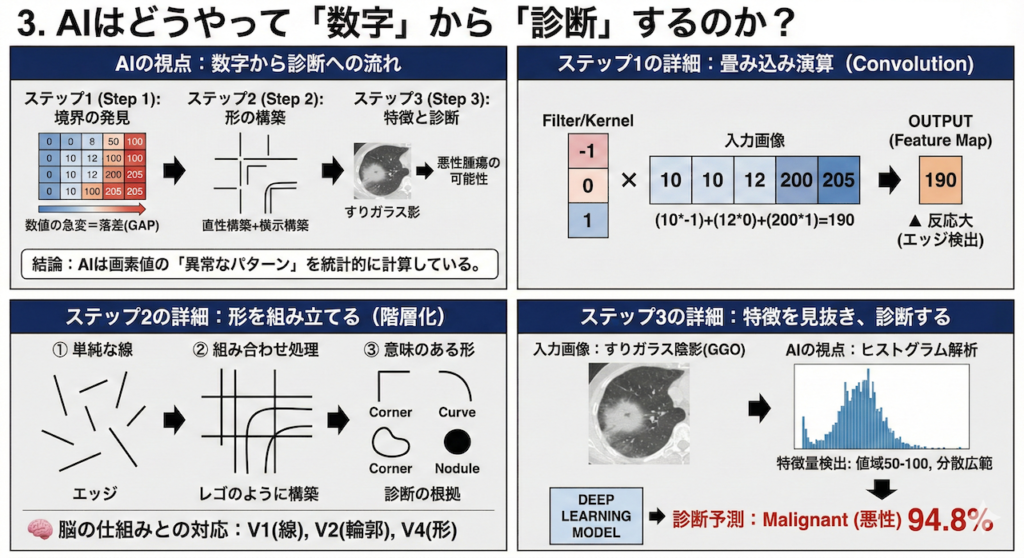

3. AIはどうやって「数字」から「診断」するのか?

ここが今回のハイライトです。

「画像が数字の行列であることはわかった。しかし、その無味乾燥な数字の羅列から、どうやって『悪性腫瘍』や『間質性肺炎』といった複雑な病態を判断しているのか?」

不思議に思われるかもしれません。人間が「0」や「255」が並んだ巨大なエクセルシートを眺めても、そこに肺がんを見つけることは不可能です。しかし、現在の医療AIの主流である「ディープラーニング(深層学習)」、特に畳み込みニューラルネットワーク(CNN: Convolutional Neural Network)は、人間とは全く異なるアプローチでこれを成し遂げます。

その秘密を解くキーワードは、「フィルター(畳み込み)」と「落差(ギャップ)」です。

ステップ1:境界線を見つける(数学的な「エッジ検出」)

AIは画像を「見る」のではなく、「フィルター」と呼ばれる小さな窓を画像の上でスライドさせながら計算しています。これを専門用語で「畳み込み演算(Convolution)」と呼びます (LeCun et al., 2015)。

例えば、あるCT画像の1行に、腫瘍の境界線(黒から白へ変わる部分)があったとしましょう。数字で表すと以下のようになります。

... 10, 10, 10, 12, 【200】, 205, 200 ...

(黒: 肺野) (白: 腫瘍)ここで、AIは「縦の境界線を見つけるフィルター(カーネル)」を使います。これは例えば \([-1, 0, 1]\) という単純な3つの数字のセットです。

このフィルターを、画像データ(数字の列)に重ねて掛け算と足し算(積和演算)を行います。

平坦な場所(10, 10, 10)にフィルターを当てても、結果はほぼ「0」になります。変化がないからです。

しかし、「12(黒)」と「200(白)」の境界部分にこのフィルターがかかるとどうなるでしょうか?

\[ \begin{aligned} \text{出力} &= (10 \times -1) + (12 \times 0) + (200 \times 1) \\ &= -10 + 0 + 200 \\ &= \mathbf{190} \quad (\text{大きな反応!}) \end{aligned} \]

このように、「数字が急激に跳ね上がる場所(=エッジ)」だけで、計算結果が極端に大きな値を示します。

AIはこの単純な計算を画像全体に対して何百万回も繰り返すことで、「どこに輪郭があるか」という地図(特徴マップ)を自動的に作成しているのです。

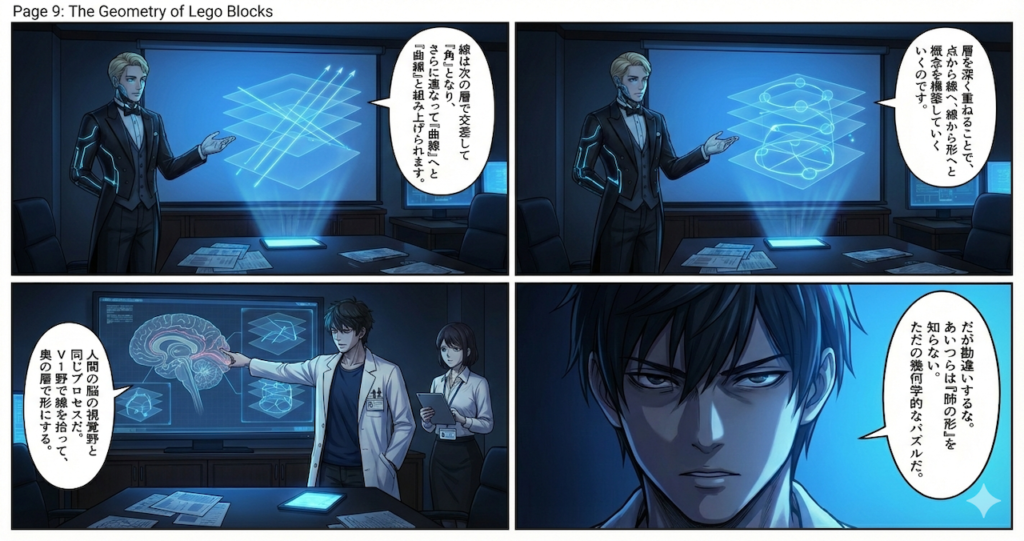

ステップ2:形を組み立てる(レイヤーの階層化)

次に、AIは見つけた「線(エッジ)」の情報を、次の層(レイヤー)へと渡します。ここでは、単純な線がレゴブロックのように組み合わされます。

- 「縦の線」と「横の線」が特定の位置で交差している ➡ 「角(コーナー)」として認識

- 「短い線」が連続して角度を変えている ➡ 「曲線(カーブ)」として認識

- 「曲線」が360度つながっている ➡ 「円形構造(結節の候補)」として認識

このプロセスは、私たちの脳の視覚野(V1野からV2、V4野へ至る経路)で行われている情報処理と非常に似ていることが知られています。AIは深層学習の「層(Layer)」を深く重ねることで、点から線へ、線から形へと、より抽象的な概念を構築していきます。

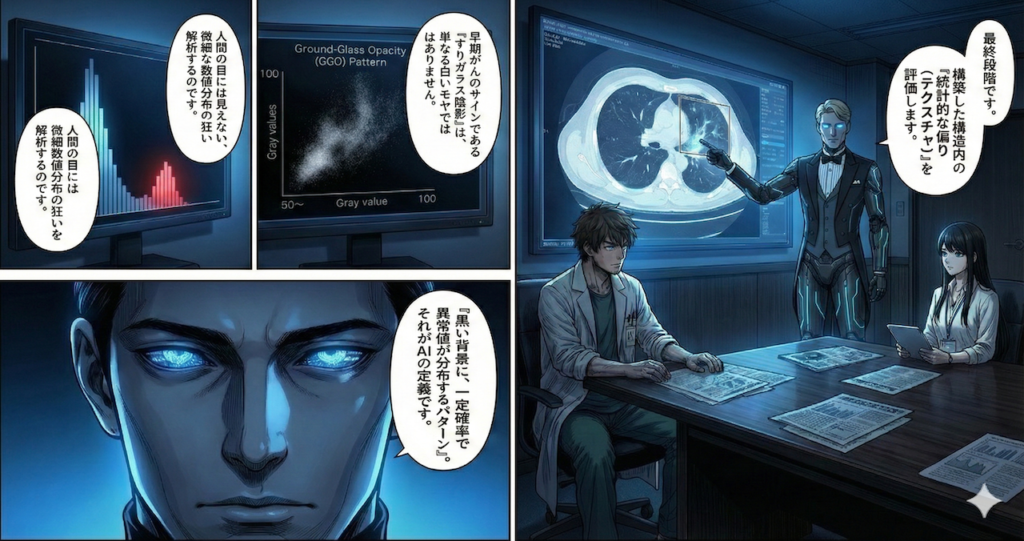

ステップ3:特徴を見抜き、診断する

最終段階では、組み立てられた形の中に、さらに高度な「テクスチャ(質感)」や「統計的な偏り」がないかを検証します。

例えば、すりガラス陰影(GGO)をAIが見るとき、それは「白いモヤ」として見ているのではありません。

「周囲の黒い背景ピクセルの中に、一定の確率分布でグレー(数値50〜100程度)のピクセルが散らばっており、かつその境界線(勾配)がなだらかである」という、極めて具体的な数値パターンとして認識しています。

AIは、数千、数万枚もの「がんの画像(正解データ)」と「正常な画像」を読み込むトレーニング(学習)を通じて、この特有の数値パターンを識別する最適な「フィルターの係数(重み)」を自動的に獲得します。

人間が「ここを見て」と教えるのではなく、AI自身が「このフィルターを通すと、がんと正常を一番うまく区別できる」という計算式を発見するのです。

実際、皮膚病変の分類タスクにおいては、このプロセスを経ることで、熟練した皮膚科医に匹敵、あるいは一部上回る識別性能が報告されています (Esteva et al., 2017)。また、病理画像の解析においても、細胞核の異型性や配列の乱れといった微細な特徴を、ピクセルレベルの数値解析から検出する試みが進んでいます (Litjens et al., 2017)。

小まとめ:AIの視界=巨大な数字の地図

ここまで見てきたように、AIにとって画像とは「ピクセルごとの数字が並んだ地図」であり、診断とは「その地図上で特定の計算結果(反応)が強くなるエリアを探す作業」に他なりません。

次に、この「計算機の目」が持つ凄さと、同時に孕んでいる危うさについて解説します。

4. 臨床医が知っておくべき「AIの目」の真実

「画像=数字」という本質を理解すると、AIの「凄さ」と「危うさ」の両方が見えてきます。

凄さ:人間には見えない「階調」が見える

私たち人間の目は、実はそれほど無限に細かい階調を見分けられるわけではありません。白と黒の間のグレーの濃淡(階調)は、実験条件によっては100〜数百程度の識別段階が報告されていますが、臨床の現場で安定して使い分けられるのはそのごく一部と考えられます (Carter, 1993)。

しかし、AIにとって「150」の明るさと「152」の明るさは、明確に異なる数字です。人間には「同じグレー」に見える領域でも、AIには「ここにわずかな濃度の変化がある」と見抜くことができます。これが、人間が見逃してしまうような極めて早期の病変や、組織の微細な不均一性をAIが検出できる可能性がある理由の一つです (Litjens et al., 2017)。

危うさ:ノイズという「嘘」に騙される

一方で、この特性は弱点にもなります。

「アドバーサリアル・アタック(Adversarial Attack)」という言葉があります。

例えば、悪性の皮膚腫瘍の画像全体に、人間には知覚できないレベルの微細なノイズ(特殊な数字のパターン)を上書きします。見た目はどう見ても「悪性腫瘍」のままです。

しかし、研究レベルの実験では、こうした微細なノイズを加えるだけで、学習済みのモデルが自信をもって「これは良性のほくろです」と誤った判定をしてしまうケースが報告されています (Finlayson et al., 2019)。

現時点で日常診療のPACSやビューアにそのまま当てはまるわけではありませんが、将来、医療現場でAIを安全に運用するうえで無視できないリスクとして議論されています。

AIは「病変の形(意味)」を見ているのではなく、「ピクセルごとの数字の計算結果」だけで判断しているため、計算結果を狂わせるような「意地悪な数字」を混ぜられると、診断ロジックが崩壊してしまうことがあるのです。

まとめ:ブラックボックスの扉を開く

いかがでしたでしょうか。

「AIは画像をどう見ているのか」。その答えは、魔法でも超能力でもなく、「エクセルシート上の膨大な数字の処理」でした。

この感覚を持っているだけで、AIの診断結果を見たときに「なぜここで間違えたのか?」「なぜこれが見えたのか?」を推測する解像度が劇的に上がります。AIは、私たちとは全く違う「目」を持つ、異質のパートナーなのです。

さて、次回は視覚の世界を離れ、「言葉」の世界へ向かいます。

画像が「数字の行列」だとしたら、言葉は一体どんな形をしているのでしょうか?

予告しましょう。言葉は「空間を飛ぶ矢印(ベクトル)」になります。

参考文献

- Bushberg, J.T., Seibert, J.A., Leidholdt, E.M. and Boone, J.M. (2012). The Essential Physics of Medical Imaging. 3rd ed. Philadelphia: Lippincott Williams & Wilkins.

- Carter, R.C. (1993). Gray scale and achromatic color difference. Journal of the Optical Society of America A, 10(6), pp.1380–1391.

- Esteva, A., Kuprel, B., Novoa, R.A., Ko, J., Swetter, S.M., Blau, H.M. and Thrun, S. (2017). Dermatologist-level classification of skin cancer with deep neural networks. Nature, 542(7639), pp.115–118.

- Finlayson, S.G., Bowers, J.D., Ito, J., Zittrain, J.L., Beam, A.L. and Kohane, I.S. (2019). Adversarial attacks on medical machine learning. Science, 363(6433), pp.1287–1289.

- Goodfellow, I.J., Shlens, J. and Szegedy, C. (2015). Explaining and harnessing adversarial examples. International Conference on Learning Representations (ICLR).

- LeCun, Y., Bengio, Y. and Hinton, G. (2015). Deep learning. Nature, 521(7553), pp.436–444.

- Litjens, G., Kooi, T., Bejnordi, B.E., Setio, A.A.A., Ciompi, F., Ghafoorian, M., van der Laak, J.A.W.M. and van Ginneken, B. (2017). A survey on deep learning in medical image analysis. Medical Image Analysis, 42, pp.60–88.

※本記事は情報提供を目的としたものであり、特定の治療法や医療機器、ソフトウェアの利用を推奨するものではありません。健康状態や治療方針に関する判断は、必ず担当の医師など専門の医療機関にご相談ください。

ご利用規約(免責事項)

当サイト(以下「本サイト」といいます)をご利用になる前に、本ご利用規約(以下「本規約」といいます)をよくお読みください。本サイトを利用された時点で、利用者は本規約の全ての条項に同意したものとみなします。

第1条(目的と情報の性質)

- 本サイトは、医療分野におけるAI技術に関する一般的な情報提供および技術的な学習機会の提供を唯一の目的とします。

- 本サイトで提供されるすべてのコンテンツ(文章、図表、コード、データセットの紹介等を含みますが、これらに限定されません)は、一般的な学習参考用であり、いかなる場合も医学的な助言、診断、治療、またはこれらに準ずる行為(以下「医行為等」といいます)を提供するものではありません。

- 本サイトのコンテンツは、特定の製品、技術、または治療法の有効性、安全性を保証、推奨、または広告・販売促進するものではありません。紹介する技術には研究開発段階のものが含まれており、その臨床応用には、さらなる研究と国内外の規制当局による正式な承認が別途必要です。

- 本サイトは、情報提供を目的としたものであり、特定の治療法を推奨するものではありません。健康に関するご懸念やご相談は、必ず専門の医療機関にご相談ください。

第2条(法令等の遵守)

利用者は、本サイトの利用にあたり、医師法、医薬品、医療機器等の品質、有効性及び安全性の確保等に関する法律(薬機法)、個人情報の保護に関する法律、医療法、医療広告ガイドライン、その他関連する国内外の全ての法令、条例、規則、および各省庁・学会等が定める最新のガイドライン等を、自らの責任において遵守するものとします。これらの適用判断についても、利用者が自ら関係各所に確認するものとし、本サイトは一切の責任を負いません。

第3条(医療行為における責任)

- 本サイトで紹介するAI技術・手法は、あくまで研究段階の技術的解説であり、実際の臨床現場での診断・治療を代替、補助、または推奨するものでは一切ありません。

- 医行為等に関する最終的な判断、決定、およびそれに伴う一切の責任は、必ず法律上その資格を認められた医療専門家(医師、歯科医師等)が負うものとします。AIによる出力を、資格を有する専門家による独立した検証および判断を経ずに利用することを固く禁じます。

- 本サイトの情報に基づくいかなる行為によって利用者または第三者に損害が生じた場合も、本サイト運営者は一切の責任を負いません。実際の臨床判断に際しては、必ず担当の医療専門家にご相談ください。本サイトの利用によって、利用者と本サイト運営者の間に、医師と患者の関係、またはその他いかなる専門的な関係も成立するものではありません。

第4条(情報の正確性・完全性・有用性)

- 本サイトは、掲載する情報(数値、事例、ソースコード、ライブラリのバージョン等)の正確性、完全性、網羅性、有用性、特定目的への適合性、その他一切の事項について、何ら保証するものではありません。

- 掲載情報は執筆時点のものであり、予告なく変更または削除されることがあります。また、技術の進展、ライブラリの更新等により、情報は古くなる可能性があります。利用者は、必ず自身で公式ドキュメント等の最新情報を確認し、自らの責任で情報を利用するものとします。

第5条(AI生成コンテンツに関する注意事項)

本サイトのコンテンツには、AIによる提案を基に作成された部分が含まれる場合がありますが、公開にあたっては人間による監修・編集を経ています。利用者が生成AI等を用いる際は、ハルシネーション(事実に基づかない情報の生成)やバイアスのリスクが内在することを十分に理解し、その出力を鵜呑みにすることなく、必ず専門家による検証を行うものとします。

第6条(知的財産権)

- 本サイトを構成するすべてのコンテンツに関する著作権、商標権、その他一切の知的財産権は、本サイト運営者または正当な権利を有する第三者に帰属します。

- 本サイトのコンテンツを引用、転載、複製、改変、その他の二次利用を行う場合は、著作権法その他関連法規を遵守し、必ず出典を明記するとともに、権利者の許諾を得るなど、適切な手続きを自らの責任で行うものとします。

第7条(プライバシー・倫理)

本サイトで紹介または言及されるデータセット等を利用する場合、利用者は当該データセットに付随するライセンス条件および研究倫理指針を厳格に遵守し、個人情報の匿名化や同意取得の確認など、適用される法規制に基づき必要とされるすべての措置を、自らの責任において講じるものとします。

第8条(利用環境)

本サイトで紹介するソースコードやライブラリは、執筆時点で特定のバージョンおよび実行環境(OS、ハードウェア、依存パッケージ等)を前提としています。利用者の環境における動作を保証するものではなく、互換性の問題等に起因するいかなる不利益・損害についても、本サイト運営者は責任を負いません。

第9条(免責事項)

- 本サイト運営者は、利用者が本サイトを利用したこと、または利用できなかったことによって生じる一切の損害(直接損害、間接損害、付随的損害、特別損害、懲罰的損害、逸失利益、データの消失、プログラムの毀損等を含みますが、これらに限定されません)について、その原因の如何を問わず、一切の法的責任を負わないものとします。

- 本サイトの利用は、学習および研究目的に限定されるものとし、それ以外の目的での利用はご遠慮ください。

- 本サイトの利用に関連して、利用者と第三者との間で紛争が生じた場合、利用者は自らの費用と責任においてこれを解決するものとし、本サイト運営者に一切の迷惑または損害を与えないものとします。

- 本サイト運営者は、いつでも予告なく本サイトの運営を中断、中止、または内容を変更できるものとし、これによって利用者に生じたいかなる損害についても責任を負いません。

第10条(規約の変更)

本サイト運営者は、必要と判断した場合、利用者の承諾を得ることなく、いつでも本規約を変更することができます。変更後の規約は、本サイト上に掲載された時点で効力を生じるものとし、利用者は変更後の規約に拘束されるものとします。

第11条(準拠法および合意管轄)

本規約の解釈にあたっては、日本法を準拠法とします。本サイトの利用および本規約に関連して生じる一切の紛争については、東京地方裁判所を第一審の専属的合意管轄裁判所とします。

For J³, may joy follow you.