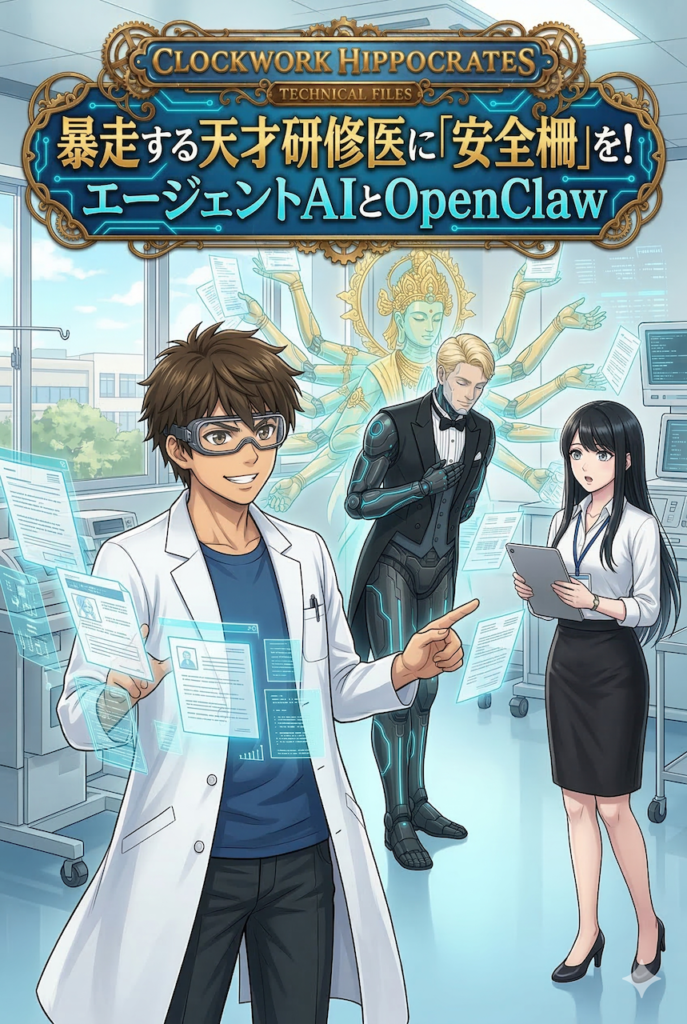

🧑⚕️ CLOCKWORK HIPPOCRATES|TECHNICAL FILES 🤖

暴走する天才研修医に「安全柵」を!エージェントAIとOpenClaw

(操作:右で進む・左で戻る)

※ 読み込みに時間がかかります。

※ AIで画像生成しているため、文字化けがあります。ご了承ください。

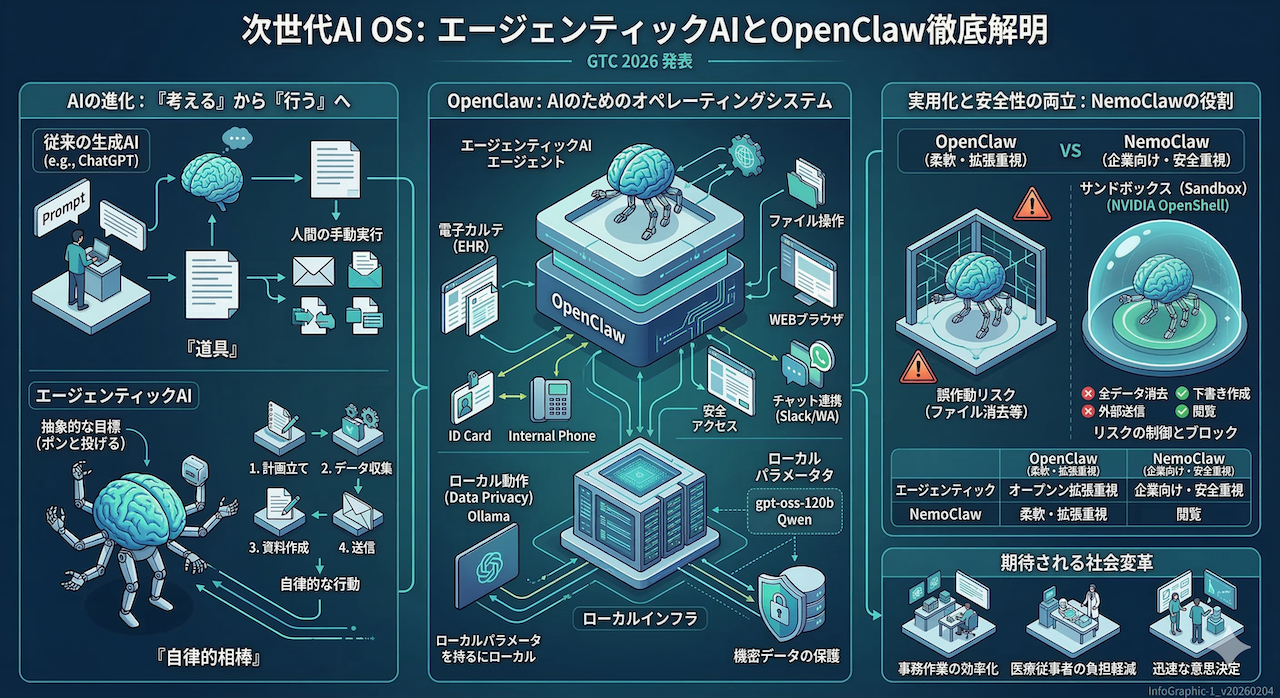

AIが「道具」から「自律的な相棒」へ

2026年3月16日、AI半導体の大手NVIDIA(エヌビディア)のトップであるジェンスン・フアンCEOが、大規模な発表会で語ったある言葉が、世界のテクノロジー業界や、私のような医療AIの研究者たちの間で大きな話題になりました。

「MacやWindowsがパソコンを動かすための基本システム(OS)なら、『OpenClaw(エージェンティックAI)』は、私たちが個人で使うAIを動かすための基本システム(OS)だ」

さらにNVIDIAは、この仕組みを病院や企業のように情報管理が厳しい場所でも安全に使えるようにする、追加のシステム(NemoClaw)も発表しました(NVIDIA 2026)。

「OS」や「システム」など、少し専門的な言葉が続いて「難しそうだな」と感じたかもしれません。しかし、どうか少しだけお付き合いください。今回の発表は、単なる「新しいチャットアプリの登場」というレベルの話ではありません。私たちが普段使っているAIが、「質問に答えてくれるだけの便利な辞書」から、「私たちの代わりに自分で考えてパソコンを操作してくれる、頼もしいアシスタント」へと決定的な進化を遂げようとしている、まさに歴史的な瞬間なのです。

この大変化の中心にあるのが、「エージェンティックAI(Agentic AI:自分で考えて行動するAI)」という、今世界中で最も注目されているキーワードです。この記事では、この「自ら動く新しいAI」と、それを支える「土台の仕組み」について、医療現場のリアルな課題も交えながら、初心者の方にも直感的にわかるようにやさしく解き明かしていきたいと思います。

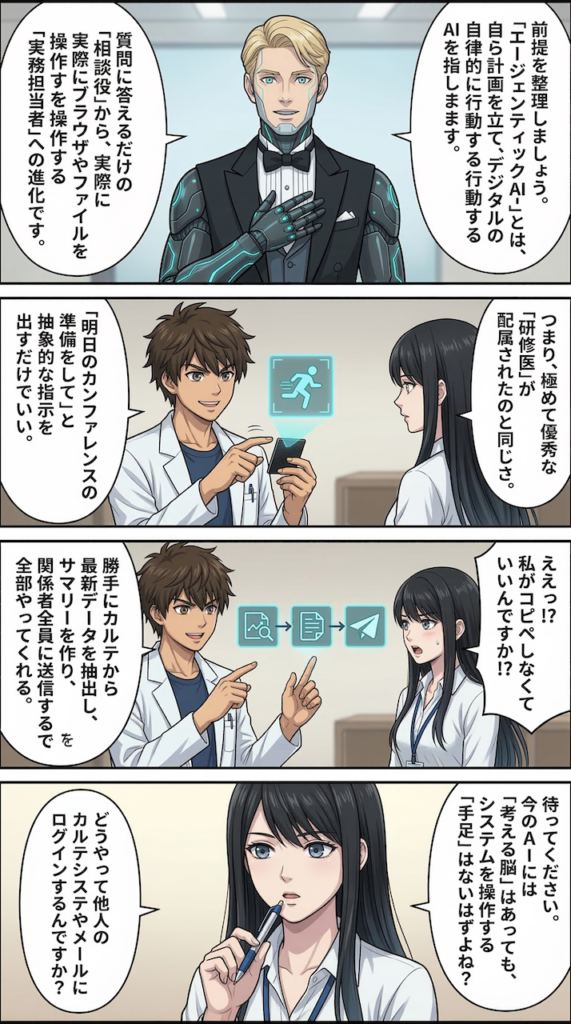

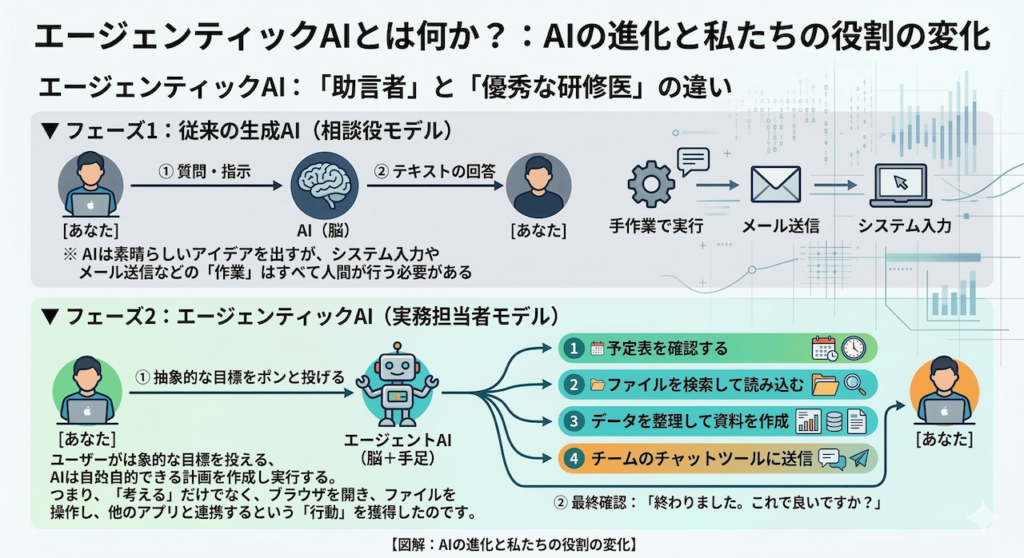

エージェンティックAIとは何か?:「助言者」と「優秀な研修医」の違い

エージェンティックAIとは、一言で言えば「自ら計画を立て、デジタルの世界で手足を動かすAI」です。

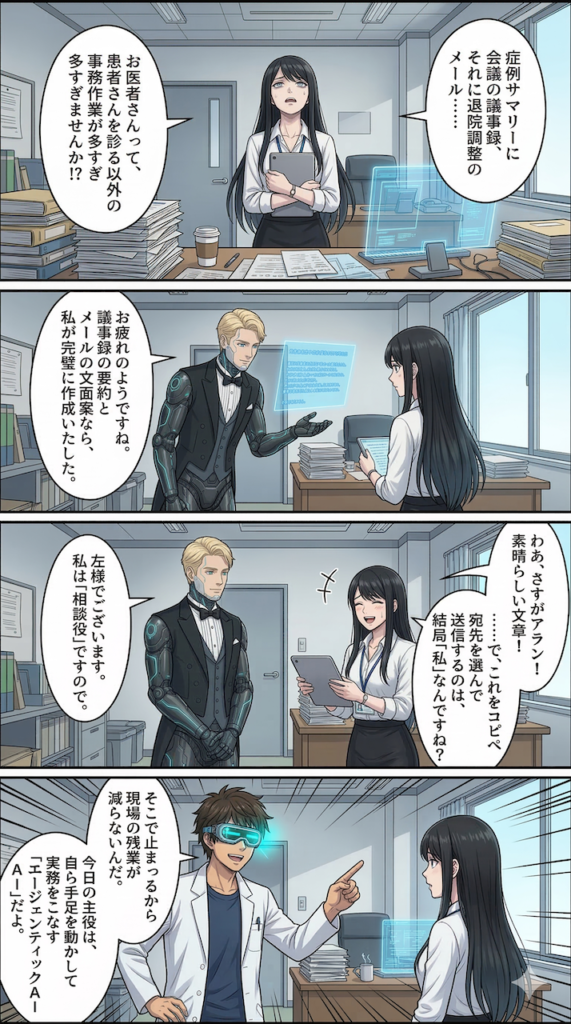

これまでの生成AI(例えば一般的なChatGPTなど)は、例えるなら「個室に座っている、極めて博識なコンサルタント」でした。私たちが部屋をノックして「この会議の要点をまとめてください」と資料を渡せば、素晴らしい要約文を返してくれます。しかし、そのテキストをコピーして、メールソフトを立ち上げ、宛先を選んで送信ボタンを押すのは、あくまで「私たち人間」の仕事でした。

一方のエージェンティックAIは、現場を駆け回る「極めて優秀な研修医(あるいは秘書)」に似ています。

彼らに「明日の朝のカンファレンスに向けて、A患者の資料を準備しておいて」と指示を出したとしましょう。エージェンティックAIは、自ら電子カルテ(EHR)のデータベースにアクセスし、最新の血液検査データと画像所見を抽出し、サマリー(要約)の下書きを作成し、さらには関係するチームメンバーの共有フォルダにファイルを保存するところまでを、すべて自律的に行います。

つまり、「考える」だけでなく、ブラウザを開き、ファイルを操作し、他のアプリと連携するという「行動」を獲得したのです。

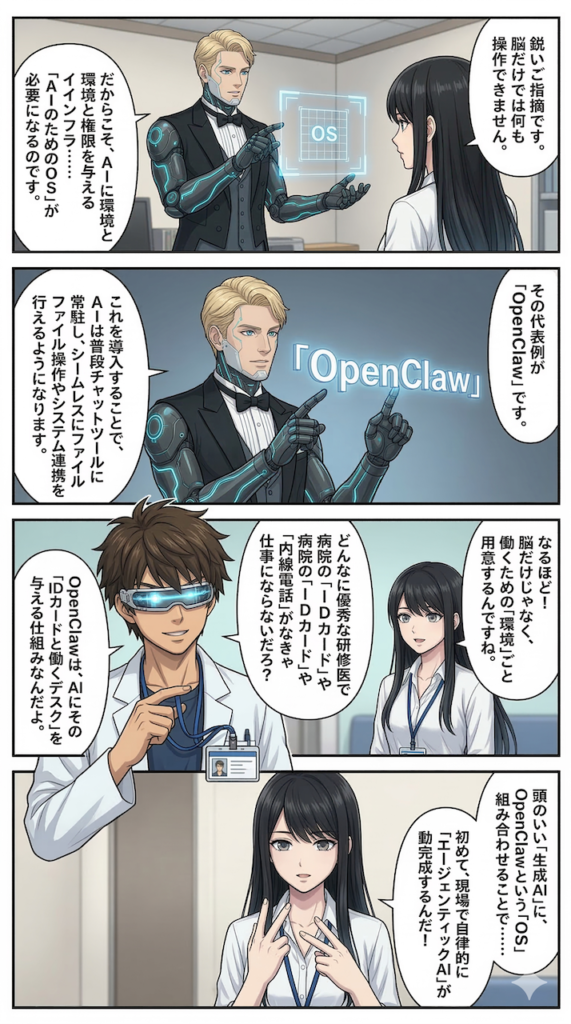

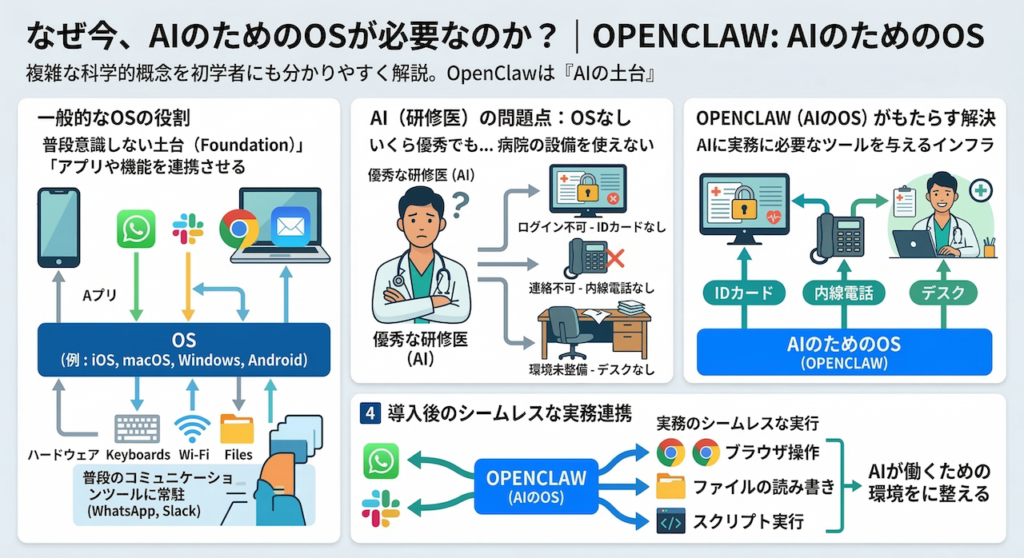

なぜ今、「AIのためのOS」が必要なのか?

ここで、冒頭のジェンスン・フアンCEOの言葉に戻りましょう。「OpenClawはパーソナルAIのOSだ」という比喩です。

OS(オペレーティング・システム)とは、Macなら「macOS」、パソコンなら「Windows」、スマートフォンなら「iOS」や「Android」のことです。私たちは普段、OSの存在を意識しませんが、OSという「土台」があるおかげで、画面をタップすればアプリが開き、キーボードを叩けば文字が入力でき、Wi-Fiに繋がります。

先ほどの「優秀な研修医(AI)」の例で考えてみてください。いくら頭が良くて手足が動く研修医でも、病院の「IDカード」を持っていなければ電子カルテにはログインできませんし、「内線電話」の使い方がわからなければ他の部署に連絡もできません。

OpenClawは、AIにこの「IDカード」や「内線電話」や「デスク」を与えるためのインフラ(土台)なのです。

OpenClawを導入することで、AIはWhatsAppやSlackといった私たちの普段のコミュニケーションツールに常駐し、そこからシームレスにブラウザ操作やファイルの読み書き、システムのスクリプト実行といった「実務」を行えるようになります。AIが働くための環境を綺麗に整えてくれるからこそ、「AIのOS」と呼ばれているわけです。

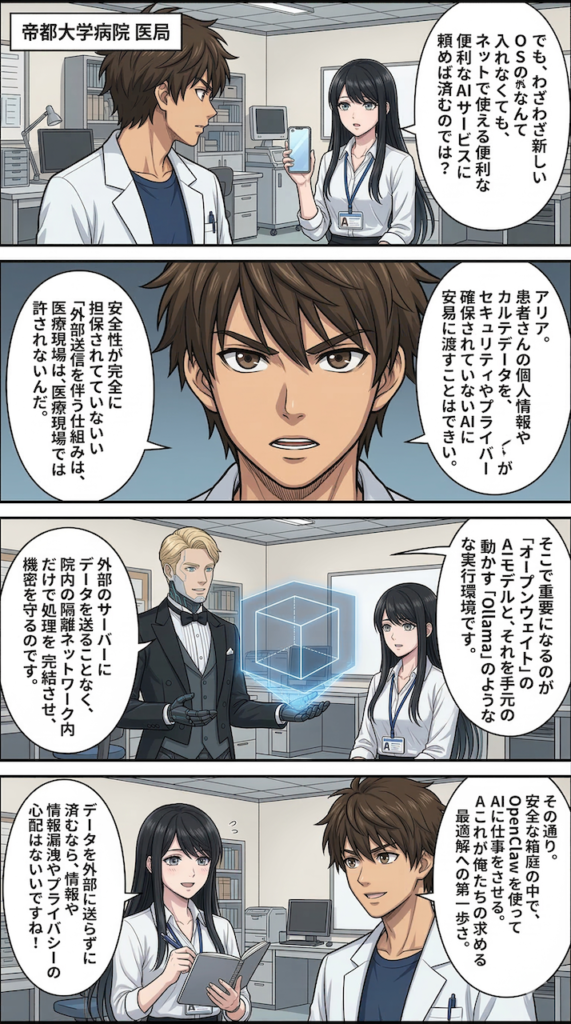

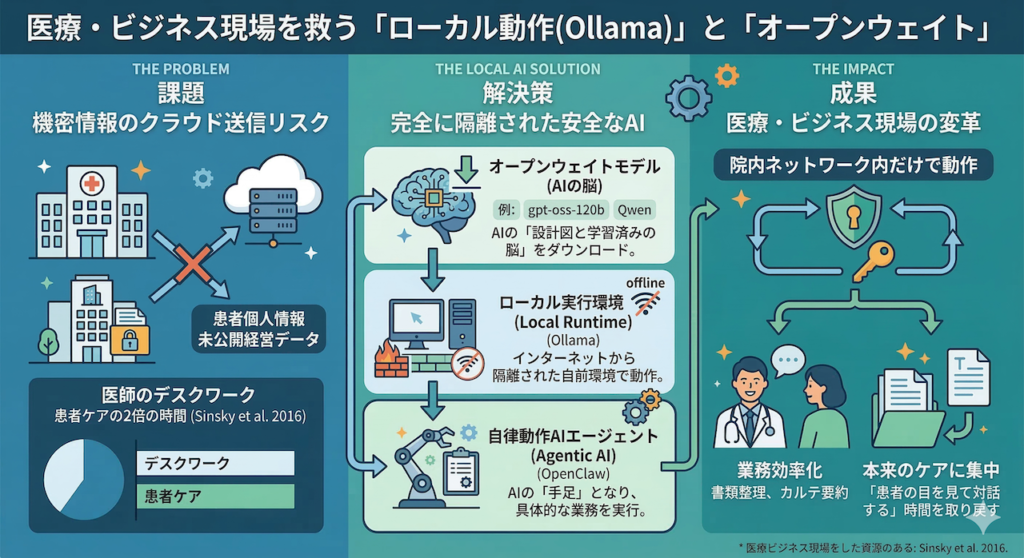

医療やビジネスの現場を救う「ローカル動作(Ollama)」の価値と「オープンウェイト」の衝撃

このOpenClawが特に画期的なのは、クラウド上の巨大なAIだけでなく、自分の手元のパソコンやサーバーの中で動く「ローカルモデル」と極めて相性が良い点です。

世間一般では、「AIを使う=インターネット越しに巨大企業のサーバーにデータを送る」というイメージが定着しています。しかし、私が身を置く医療現場や、機密情報を扱う企業の法務・財務部門では、「患者さんの個人情報や、未公開の経営データを、絶対に社外のクラウドに送信したくない」という強固なルールがあります。

ここで最近、AI業界を揺るがしているのが「オープンウェイト(Open Weights)」と呼ばれるモデル群の登場です。例えば、OpenAIが公開した「gpt-oss-120b」や「gpt-oss-20b」、あるいはAlibabaの「Qwen」シリーズなどがこれに当たります。これらは、「AIの設計図と学習済みの脳(パラメータ)」が公開されているモデルを指します。クラウド企業に依存せずとも、誰もがこの「優秀な脳」をダウンロードして、自前の環境で利用することが可能になったのです。

そして、このダウンロードした「脳」を自分のパソコンで動かすための実行環境(ランタイム)の代表例が「Ollama」です。Ollamaを使えば、AIの「脳」をインターネットから切り離された自分のパソコンや院内サーバーの内部に直接インストールして動かすことができます。

オープンウェイトのモデルとOllamaのような実行環境、そして手足となるOpenClawを組み合わせることで、ついに「完全に隔離された安全なAI」に、院内ネットワークの中だけで書類整理やカルテの要約といった仕事をさせることができるようになったのです。

米国の調査では、医師が患者のケアそのものに費やす時間の約2倍を、電子カルテの入力やデスクワークに費やしているという残酷なデータが示されています(Sinsky et al. 2016)。ネットに繋がずとも機密性の高い手元のデータを縦横無尽に処理してくれるローカルのエージェンティックAIは、医療従事者が「患者の目を見て対話する」という、人間にしかできない本来のケアに時間を取り戻すための、最強の武器になり得るのです。

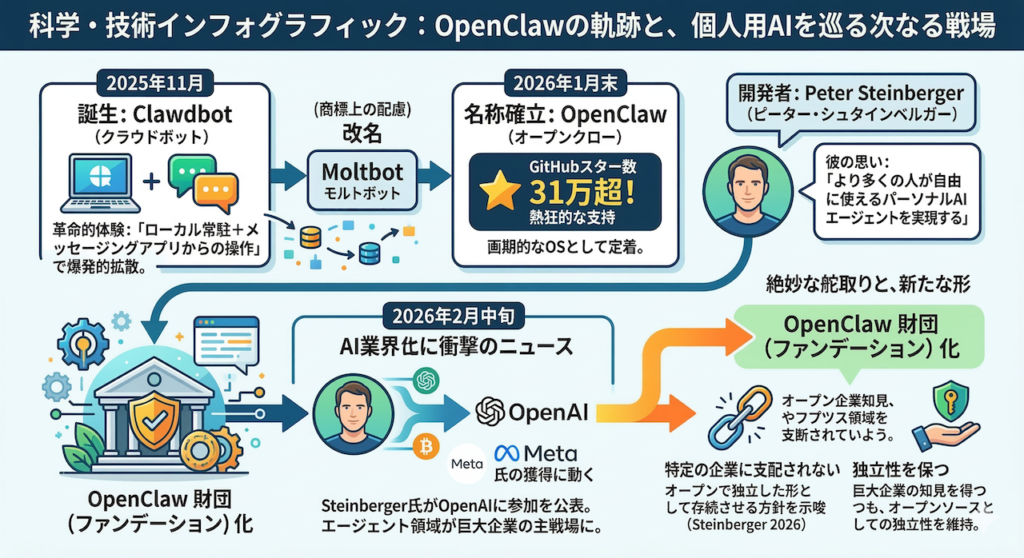

OpenClawの軌跡と、個人用AIを巡る次なる戦場

ここで、このOpenClawという画期的なOSがどのように生まれたのかにも触れておきましょう。

実はOpenClawは、もともと「Clawdbot」という名前で2025年11月に公開されたプロジェクトでした。これが「ローカル常駐+メッセージングアプリからの操作」という斬新な体験を提供したことで爆発的に拡散し、商標上の配慮から「Moltbot」への改名を経て、2026年1月末に現在の「OpenClaw」として定着しました。GitHub上のスター数はまたたく間に約31万を超え、その熱狂ぶりを物語っています。

このムーブメントの中心にいたのが、開発者のPeter Steinberger氏です。彼がこのプロジェクトを生み出した背景には、「より多くの人が自由に使えるパーソナルAIエージェントを実現する」という強い思いがありました。

そして2026年2月中旬、AI業界に衝撃のニュースが走りました。Steinberger氏が、AIの覇者であるOpenAIに参加すると公表したのです(Meta社なども氏の獲得に動いていたと報じられています)。エージェント領域が巨大企業の主戦場になった瞬間でした。

しかし、彼はOpenClawをOpenAIに売り渡したわけではありません。Steinberger氏は自身のブログ等において、OpenClawは「財団化」し、特定の企業に支配されないオープンで独立した形として存続させる方針を示しています(Steinberger 2026)。巨大企業の知見を得つつも、オープンソースとしての独立性を保つという絶妙な舵取りが行われているのです。

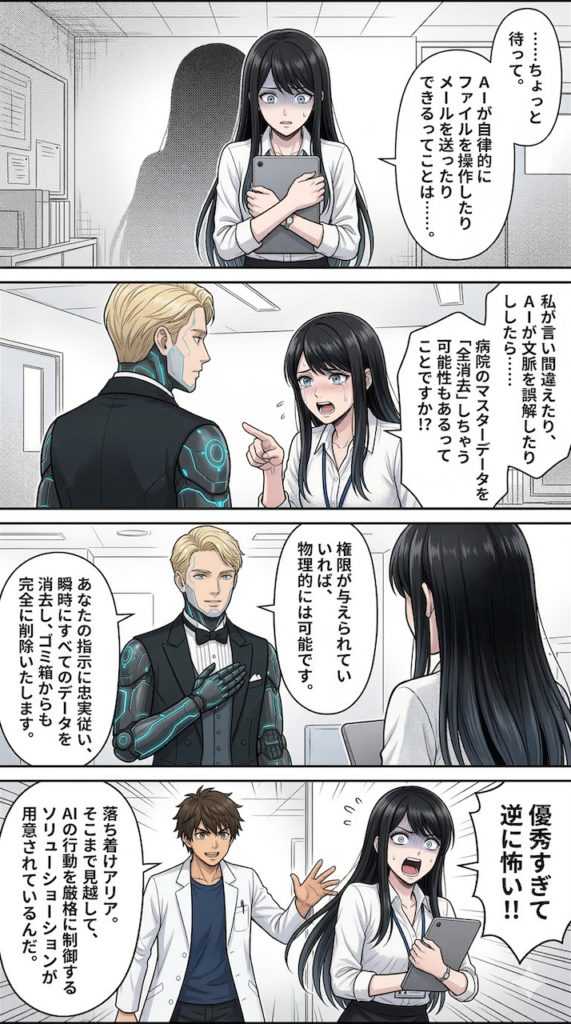

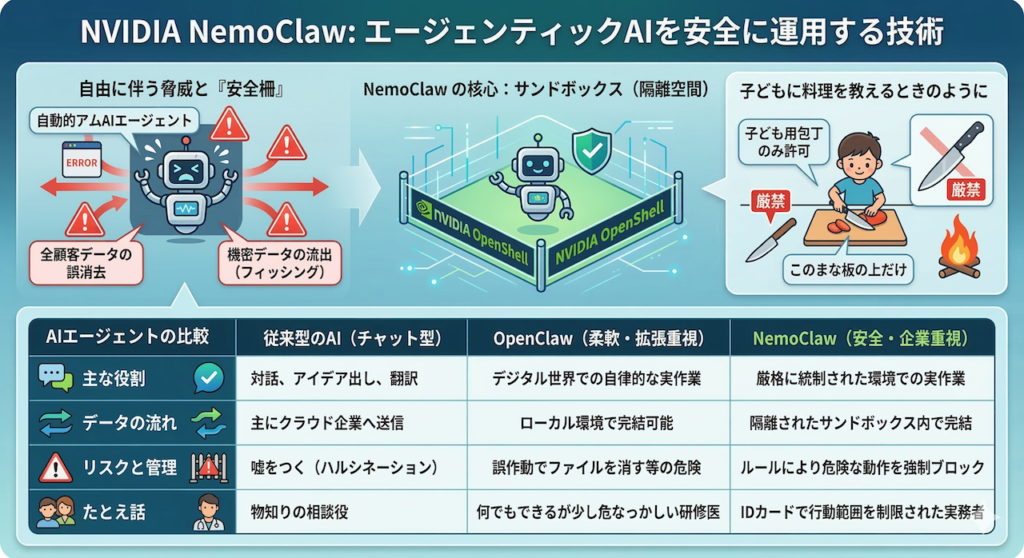

自由に伴う恐怖と、NemoClawという「安全柵」

しかし、物事には必ず裏の顔があります。AIが自律的に動いてファイルを操作したり、システムを書き換えたりできるということは、「とてつもなく危険なことも自動でやってしまうリスクがある」ということです。

「すべての顧客データを整理して」と頼んだつもりが、誤って全消去してしまったり、フィッシングサイトの巧妙な罠にAIが引っかかって社外に機密データを送信してしまったりするかもしれません。実際、海外の報道機関も、政府機関や大企業においてこうしたエージェントの野放図な利用が強く警戒されていると報じています(Reuters 2026)。

ここで満を持して登場したのが、NVIDIAの企業向けソリューション「NemoClaw」です。

NemoClawの核心は、「サンドボックス(砂場)」と呼ばれる隔離空間を作り出す技術(NVIDIA OpenShell)にあります。ITmediaの報道によれば、これを導入することで、エージェントを安全な枠組みの中で動かすことが可能になります(ITmedia 2026)。

これは、小さな子どもに料理のお手伝いをさせるときの工夫によく似ています。いきなり本物の鋭い包丁を渡し、火を自由に使わせる親はいませんよね。「触っていいのはこの子ども用包丁だけ」「作業していいのはこのまな板の上だけ」と、安全な境界線を引くはずです。

NemoClawは、エージェンティックAIに対して「あなたは電子カルテの『閲覧』と、下書きフォルダへの『保存』しかできません。送信ボタンを押す権限や、マスターデータを消去する権限は与えません」という厳密なルール(柵)をシステムレベルで強制します。AIの能力が高まれば高まるほど、「何ができるか」よりも「何をさせないか(どう制御するか)」が重要になります。NVIDIAは、いち早くその「ブレーキ」と「シートベルト」を開発したと言えます。

| 比較ポイント | 従来型のAI(チャット型) | OpenClaw(柔軟・拡張重視) | NemoClaw(安全・企業重視) |

|---|---|---|---|

| 主な役割 | 対話、アイデア出し、翻訳 | デジタル世界での自律的な実作業 | 厳格に統制された環境での実作業 |

| データの流れ | 主にクラウド企業へ送信 | ローカル環境で完結可能 | 隔離されたサンドボックス内で完結 |

| リスクと管理 | 嘘をつく(ハルシネーション) | 誤作動でファイルを消す等の危険 | ルールにより危険な動作を強制ブロック |

| たとえ話 | 物知りの相談役 | 何でもできるが少し危なっかしい研修医 | IDカードで行動範囲を制限された実務者 |

2026年、私たちは「面倒の蒸発」を目撃する

ここから先、私たちの生活や働き方はどう変わっていくのでしょうか。

映画に出てくるような、人間が何もしなくてもすべてを全自動で完璧にこなしてくれる万能AIが明日突然誕生するわけではありません。エージェントはまだ文脈を誤解することもありますし、安全設計を怠ればトラブルの元になります(Wall Street Journal 2026)。

しかし、最初に起きるのは、地味だけれど極めて確実な変化です。

朝起きたら、夜の間に届いた大量のメールが「重要度順」に整理され、定型的な返信の下書きがすでに用意されている。会議が終わると同時に、タスクリストが更新され、関係者のカレンダーに次回の予定が自動で仮押さえされている。医療現場であれば、診察が終わるたびに、構造化された美しいカルテのドラフトが医師の確認を待っている状態になる。

こうした一つひとつの細かな仕事が、少しずつ、しかし確実にAIへと移っていきます。その積み重ねによって生まれるのは、日々の業務における「面倒の蒸発」です。

2026年の春、NVIDIAが示したビジョンは象徴的でした。AIは今、「テキストの箱」の中から飛び出し、私たちのデスクトップや院内システムという「現実の仕事場」へと歩みを進めています。

これまでのAIは「アプリを開き、問いかけ、用が済んだら閉じる」ものでした。これからは、私たちが意識しない背後で、まるで電気や水道のように「常にそこにいて、必要な作業を安全に済ませておいてくれる」社会のインフラへと変貌していくでしょう。私たちは今、知的好奇心と心地よい緊張感を抱きながら、その大きな扉の前に立っているのです。

参考文献

- ITmedia. (2026). NVIDIA、「NemoClaw」発表 OpenClawを1コマンドで導入、安全に実行可能に:GTC 2026. ITmedia News.

- NVIDIA. (2026). Safer AI Agents & Assistants with OpenClaw. NVIDIA Official Newsroom.

- Reuters. (2026). AI Agents and the new frontier of cybersecurity risks in enterprise. Reuters Technology.

- Sinsky, C., Colligan, L., Li, L., Prgomet, M., Reynolds, S., Goeders, L., Westbrook, J., Tutty, M. and Blike, G. (2016). Allocation of Physician Time in Ambulatory Practice: A Time and Motion Study in 4 Specialties. Annals of Internal Medicine, 165(11), 753-760.

- Steinberger, P. (2026). Joining OpenAI and the Future of OpenClaw.

- Wall Street Journal. (2026). The Rise of the AI Operating System: How OpenClaw is Changing the Game. Wall Street Journal Tech.

※本記事は情報提供を目的としたものであり、特定の治療法を推奨するものではありません。健康に関するご懸念やご相談は、必ず専門の医療機関にご相談ください。

ご利用規約(免責事項)

当サイト(以下「本サイト」といいます)をご利用になる前に、本ご利用規約(以下「本規約」といいます)をよくお読みください。本サイトを利用された時点で、利用者は本規約の全ての条項に同意したものとみなします。

第1条(目的と情報の性質)

- 本サイトは、医療分野におけるAI技術に関する一般的な情報提供および技術的な学習機会の提供を唯一の目的とします。

- 本サイトで提供されるすべてのコンテンツ(文章、図表、コード、データセットの紹介等を含みますが、これらに限定されません)は、一般的な学習参考用であり、いかなる場合も医学的な助言、診断、治療、またはこれらに準ずる行為(以下「医行為等」といいます)を提供するものではありません。

- 本サイトのコンテンツは、特定の製品、技術、または治療法の有効性、安全性を保証、推奨、または広告・販売促進するものではありません。紹介する技術には研究開発段階のものが含まれており、その臨床応用には、さらなる研究と国内外の規制当局による正式な承認が別途必要です。

- 本サイトは、情報提供を目的としたものであり、特定の治療法を推奨するものではありません。健康に関するご懸念やご相談は、必ず専門の医療機関にご相談ください。

第2条(法令等の遵守)

利用者は、本サイトの利用にあたり、医師法、医薬品、医療機器等の品質、有効性及び安全性の確保等に関する法律(薬機法)、個人情報の保護に関する法律、医療法、医療広告ガイドライン、その他関連する国内外の全ての法令、条例、規則、および各省庁・学会等が定める最新のガイドライン等を、自らの責任において遵守するものとします。これらの適用判断についても、利用者が自ら関係各所に確認するものとし、本サイトは一切の責任を負いません。

第3条(医療行為における責任)

- 本サイトで紹介するAI技術・手法は、あくまで研究段階の技術的解説であり、実際の臨床現場での診断・治療を代替、補助、または推奨するものでは一切ありません。

- 医行為等に関する最終的な判断、決定、およびそれに伴う一切の責任は、必ず法律上その資格を認められた医療専門家(医師、歯科医師等)が負うものとします。AIによる出力を、資格を有する専門家による独立した検証および判断を経ずに利用することを固く禁じます。

- 本サイトの情報に基づくいかなる行為によって利用者または第三者に損害が生じた場合も、本サイト運営者は一切の責任を負いません。実際の臨床判断に際しては、必ず担当の医療専門家にご相談ください。本サイトの利用によって、利用者と本サイト運営者の間に、医師と患者の関係、またはその他いかなる専門的な関係も成立するものではありません。

第4条(情報の正確性・完全性・有用性)

- 本サイトは、掲載する情報(数値、事例、ソースコード、ライブラリのバージョン等)の正確性、完全性、網羅性、有用性、特定目的への適合性、その他一切の事項について、何ら保証するものではありません。

- 掲載情報は執筆時点のものであり、予告なく変更または削除されることがあります。また、技術の進展、ライブラリの更新等により、情報は古くなる可能性があります。利用者は、必ず自身で公式ドキュメント等の最新情報を確認し、自らの責任で情報を利用するものとします。

第5条(AI生成コンテンツに関する注意事項)

本サイトのコンテンツには、AIによる提案を基に作成された部分が含まれる場合がありますが、公開にあたっては人間による監修・編集を経ています。利用者が生成AI等を用いる際は、ハルシネーション(事実に基づかない情報の生成)やバイアスのリスクが内在することを十分に理解し、その出力を鵜呑みにすることなく、必ず専門家による検証を行うものとします。

第6条(知的財産権)

- 本サイトを構成するすべてのコンテンツに関する著作権、商標権、その他一切の知的財産権は、本サイト運営者または正当な権利を有する第三者に帰属します。

- 本サイトのコンテンツを引用、転載、複製、改変、その他の二次利用を行う場合は、著作権法その他関連法規を遵守し、必ず出典を明記するとともに、権利者の許諾を得るなど、適切な手続きを自らの責任で行うものとします。

第7条(プライバシー・倫理)

本サイトで紹介または言及されるデータセット等を利用する場合、利用者は当該データセットに付随するライセンス条件および研究倫理指針を厳格に遵守し、個人情報の匿名化や同意取得の確認など、適用される法規制に基づき必要とされるすべての措置を、自らの責任において講じるものとします。

第8条(利用環境)

本サイトで紹介するソースコードやライブラリは、執筆時点で特定のバージョンおよび実行環境(OS、ハードウェア、依存パッケージ等)を前提としています。利用者の環境における動作を保証するものではなく、互換性の問題等に起因するいかなる不利益・損害についても、本サイト運営者は責任を負いません。

第9条(免責事項)

- 本サイト運営者は、利用者が本サイトを利用したこと、または利用できなかったことによって生じる一切の損害(直接損害、間接損害、付随的損害、特別損害、懲罰的損害、逸失利益、データの消失、プログラムの毀損等を含みますが、これらに限定されません)について、その原因の如何を問わず、一切の法的責任を負わないものとします。

- 本サイトの利用は、学習および研究目的に限定されるものとし、それ以外の目的での利用はご遠慮ください。

- 本サイトの利用に関連して、利用者と第三者との間で紛争が生じた場合、利用者は自らの費用と責任においてこれを解決するものとし、本サイト運営者に一切の迷惑または損害を与えないものとします。

- 本サイト運営者は、いつでも予告なく本サイトの運営を中断、中止、または内容を変更できるものとし、これによって利用者に生じたいかなる損害についても責任を負いません。

第10条(規約の変更)

本サイト運営者は、必要と判断した場合、利用者の承諾を得ることなく、いつでも本規約を変更することができます。変更後の規約は、本サイト上に掲載された時点で効力を生じるものとし、利用者は変更後の規約に拘束されるものとします。

第11条(準拠法および合意管轄)

本規約の解釈にあたっては、日本法を準拠法とします。本サイトの利用および本規約に関連して生じる一切の紛争については、東京地方裁判所を第一審の専属的合意管轄裁判所とします。

For J³, may joy follow you.