独学の壁を超える、実装力の礎。

AI開発の共通言語であるPythonと、PyTorchなどの主要ライブラリをゼロから習得。医療データを扱うための作法と、エラーを恐れずコードを書く自信を手に入れましょう。

最新コンテンツ

-

[Medical AI with Python : P11/G2.3] Python and Deep Learning for Beginners: Building a Neural Network

-

[Medical AI with Python: P59] PyTorchでTransformer:医療時系列データ編 | 医療時系列データ分析で未来を予測する

-

[Medical AI with Python: P9.1] 医療AI開発の効率を劇的改善!Pythonデコレーターの基本と実践をわかりやすく解説

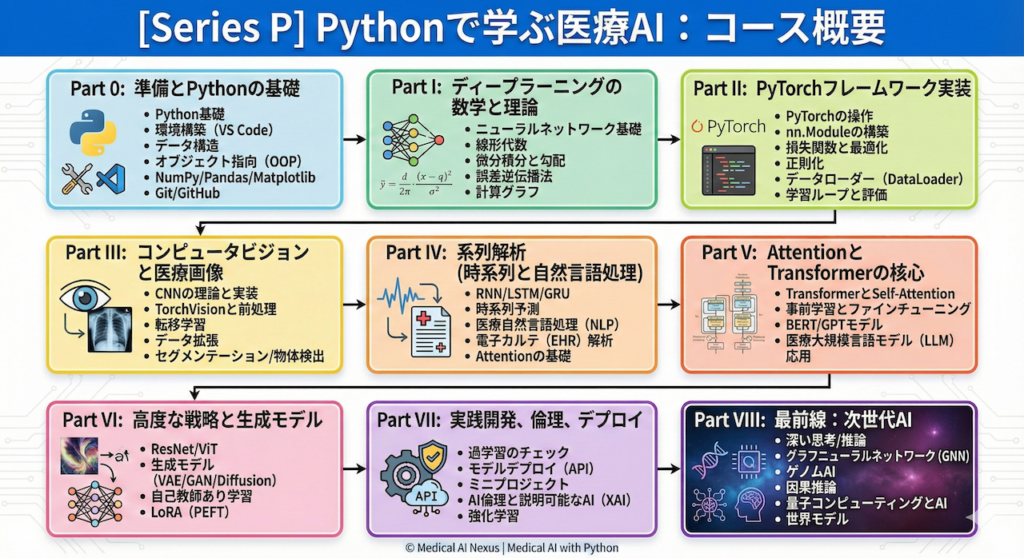

[Series P] Medical AI with Python:コースの全体像

第0部:開発準備とPythonプログラミングの礎

| ID | タイトル | 概要・キーワード |

|---|---|---|

| P0 | 第0回:ゼロから始める医療AI入門講座 ― Pythonで学ぶ開発の全体像 | Python, 医療AI, プログラミング学習ロードマップ, 開発の全体像 |

| P1 | 第1回:AnacondaとVS Codeで始める!医療AIのための開発環境構築ガイド | Anaconda, VS Code, 環境構築, インストールガイド, 開発ツール |

| P2 | 第2回:初心者でもわかるPythonの基本① ― 変数とデータ型を完全マスター | 変数, データ型 (int, float, str), 文字列操作, Python基礎 |

| P3 | 第3回:初心者でもわかるPythonの基本② ― リスト・辞書・タプルを使いこなす | データ構造, リスト (list), 辞書 (dict), タプル (tuple), データ管理 |

| P4 | 第4回:Pythonで学ぶプログラミング思考 ― if文とループで処理を自動化 | 制御構文, if文 (条件分岐), for文/while文 (ループ), 自動化処理 |

| P5 | 第5回:現場で役立つPython関数入門 ― 繰り返し処理をスッキリ整理 | 関数 (def), 引数と戻り値, コードの再利用, モジュール化 |

| P6 | 第6回:AI開発に欠かせないオブジェクト指向 ― クラスとインスタンスの基本 | オブジェクト指向 (OOP), クラス (class), インスタンス, メソッド |

| P7 | 第7回:医療AIで必須!NumPy・Pandas・Matplotlibの基礎と使い方 | データサイエンス, NumPy (数値計算), Pandas (データ操作), Matplotlib (可視化) |

| P8 | 第8回:研究再現性のための整理術 — ファイル構造とターミナルの基礎 | 研究再現性, ディレクトリ構成, ターミナルコマンド (CLI), ファイル管理 |

| P9 | 第9回:医療AI研究開発のための、Git・GitHub入門! | Git, GitHub, バージョン管理, コミット, プッシュ, 共同研究 |

| P9.1 | デコレーター, 構文糖衣, @マーク, コード効率化, ログ出力 |

第I部:ディープラーニングの数学と理論

| ID | タイトル | 概要・キーワード |

|---|---|---|

| P11 | 第11回:ニューラルネットをゼロから構築しよう!Python実装入門 | ニューラルネットワーク, パーセプトロン, 活性化関数, 順伝播 (Forward Propagation), Pythonスクラッチ実装 |

| P12 | 第12回:線形代数のエッセンス:ベクトル・行列・内積の直感的理解 | 線形代数, ベクトル, 行列演算, 内積 (Dot Product), テンソル, NumPy, 次元数 |

| P13 | 第13回:微分と勾配をマスター:連鎖律と勾配降下法のメカニズム | 数値微分, 偏微分, 勾配 (Gradient), 連鎖律 (Chain Rule), 勾配降下法, 最適化問題 |

| P14 | 第14回:誤差逆伝播を「計算グラフ」で攻略!視覚的に学ぶアルゴリズム | 誤差逆伝播法, 計算グラフ (Computational Graph), ノード, 局所的微分, 加算ノード・乗算ノードの逆伝播 |

| P15 | 第15回:ディープラーニングの心臓部:誤差逆伝播と自動微分の真髄 | Backpropagation, 自動微分 (Autograd), パラメータ更新, 学習プロセス, 勾配消失問題 |

第II部:PyTorchフレームワーク:実装の作法

| ID | タイトル | 概要・キーワード |

|---|---|---|

| P21 | 第21回:PyTorch入門:Tensor操作と自動微分の基本 | torch.Tensor, .backward(), .grad の使い方, PyTorchの基礎文法, GPU活用 |

| P22 | 第22回:PyTorchでモデルを定義!nn.Moduleの構造を理解する | nn.Module によるモデル構築, forward()メソッド, レイヤー定義, クラス継承 |

| P23 | 第23回:損失関数と最適化:MSE・CrossEntropy・SGD・Adamの使い分け | 損失関数 (MSELoss, CrossEntropyLoss), オプティマイザ (optim.SGD, optim.Adam), 学習率 |

| P24 | 第24回:モデルに「個性」と「規律」を!活性化関数と正則化による精度向上 | 活性化関数 (ReLU, Sigmoid), 過学習抑制, 正則化 (Weight Decay), Dropout, Batch Normalization |

| P25 | 第25回:大量データを効率よく学習!ミニバッチ学習とDataLoader自作術 | ミニバッチ学習, Datasetクラスの継承, DataLoader, バッチサイズ, イテレーション |

| P26 | 第26回:AIモデルの「健康診断」:学習の可視化と評価指標の選び方 | 学習曲線 (Loss Curve), 正解率 (Accuracy), 混同行列, TensorBoard, Matplotlibによる可視化 |

| P27 | 第27回:初めての総合演習!多層ニューラルネットで疾患予測に挑戦 | データ前処理, 訓練・検証ループ, 汎化性能の評価, 実践的パイプライン構築 |

第III部:コンピュータビジョン:医療画像解析の深化

| ID | タイトル | 概要・キーワード |

|---|---|---|

| P31 | 第31回:PyTorchで画像処理!医療画像分類への第一歩 | 画像認識タスクの導入, MNIST, CIFAR, コンピュータビジョン基礎 |

| P31.1 | torchvision.transforms, 正規化, テンソル変換, データ前処理 | |

| P32 | 第32回:畳み込みニューラルネットワーク(CNN)の理論と実装 | 畳み込み層 (Conv Layer), プーリング層 (Pooling), カーネル, ストライド |

| P33 | 第33回:実践!PyTorchでCNNモデルを訓練する(MNIST編) | パイプライン構築, 学習ループ, 評価指標, 手書き文字認識 |

| P34 | 第34回:データ拡張(Data Augmentation)で過学習を防ぐ | データ拡張, 回転 (Rotation), 反転 (Flip), 汎化性能向上, 過学習対策 |

| P35 | 第35回:カラー画像への挑戦!CIFAR-10による高度な分類 | RGB画像, 3チャネルデータ処理, CIFAR-10, モデルの複雑化 |

| P36 | 第36回:CNNのブラックボックスを覗く:特徴マップの可視化 | 特徴マップ, 可視化, Explainable AI (XAI), CNNの解釈性 |

| P37 | 第37回:最強の武器「学習済みモデル」!転移学習とファインチューニング | 転移学習, ファインチューニング, torchvision.models, ResNet, EfficientNet |

| P38 | 第38回:医療AI実践:PyTorchを用いた実戦的医療画像分類 | 医療画像, 小規模データセット, 実践演習, モデル訓練 |

| P39 | 第39回:画像認識の最前線へ:物体検出・セグメンテーションの展望 | 物体検出 (Object Detection), セグメンテーション, 領域分割, YOLO, U-Net |

第IV部:シーケンス解析:時系列データと医療自然言語

| ID | タイトル | 概要・キーワード |

|---|---|---|

| P41 | 第41回:AIに「時間」を教える:RNN/LSTMによる系列データ分析 | 時系列データ, 自然言語処理 (NLP), RNN, LSTM, シーケンス解析の全体像 |

| P41.1 | データ前処理, テンソル形状 (Batch, Time, Features), パディング, Dataset作成 | |

| P42 | 第42回:再帰型ニューラルネット(RNN)の理論とPyTorch実装 | RNN (Recurrent Neural Network), 隠れ層の状態遷移, 時間方向への逆伝播 (BPTT) |

| P43 | 第43回:医療時系列データをRNNで読み解く!バイタル予測の実践 | バイタルサイン予測, 時系列回帰, 異常検知, 実データへの適用 |

| P44 | 第44回:医療自然言語処理入門!RNNによるテキスト解析の基礎 | 自然言語処理 (NLP), トークン化, 単語埋め込み (Embedding), テキスト分類 |

| P45 | 第45回:長期記憶の魔法!LSTMの理論とPyTorch実装徹底解説 | LSTM (Long Short-Term Memory), 忘却ゲート, 入力ゲート, 勾配消失問題の解決 |

| P46 | 第46回:医療時系列×LSTM:高度な予後予測モデルの構築 | 予後予測, マルチモーダル学習, モデル精度向上, 複雑な時系列パターン |

| P47 | 第47回:医療NLP×LSTM:電子カルテデータの文脈を捉える | 電子カルテ解析, 文脈理解, 医療文書分類, テキストマイニング |

| P48 | 第48回:GRU(Gated Recurrent Unit)による効率的な系列モデルの実装 | GRU (Gated Recurrent Unit), 計算コスト削減, LSTMとの比較, リセットゲート |

| P49 | 第49回:系列モデルの学習テクニックと医療応用における発展的話題 | 双方向RNN (Bidirectional RNN), Attention機構, モデルの解釈性, 発展的トピック |

第V部:Attention & Transformer:現代AIの核心

| ID | タイトル | 概要・キーワード |

|---|---|---|

| P51 | 第51回:ChatGPTを支える「Transformer」徹底理解!自己回帰生成の全貌 | Transformer, ChatGPT, 大規模言語モデル (LLM), 自己回帰生成, AIの歴史的転換点 |

| P51.0 | 医療AI応用, 診断支援, カルテ要約, 生成AIの可能性, モデルアーキテクチャ概論 | |

| P52 | 第52回:Transformerの学習戦略:事前学習とファインチューニングの極意 | Next Token Prediction, 自己教師あり学習, 損失関数, 事前学習 (Pre-training), ファインチューニング |

| P53 | 第53回:Transformerのアーキテクチャ解剖:Self-Attentionから正規化まで | Multi-Head Attention, FFN, 残差接続 (Residual Connection), Positional Encoding, Layer Normalization |

| P54 | 第54回:Attentionは「何を見ているのか?」クエリ・キー・バリューの仕組み | Query/Key/Value (QKV), Attention Weight, スケーリング内積注意, マスク処理 (Causal Mask), 可視化 |

| P55 | 第55回:FFN(Feed Forward Network)の重要性:意味を深化させる非線形変換 | Feed Forward Network (FFN), 2層MLP, 活性化関数 (GELU/ReLU), 知識の貯蔵庫, 非線形変換 |

| P56 | 第56回:Decoderモデルにおける出力生成:logitsからサンプリングまで | Softmax, Logits, サンプリング戦略, Temperature, Top-k/Top-p, パラメータ共有 |

| P56.1 | 勾配流, 勾配消失対策, Pre-LN vs Post-LN, 学習の安定化 | |

| P56.2 | 計算量問題, Longformer, 長文脈対応, 医療応用, Transformer系譜 | |

| P57 | 第57回:徹底解剖!Transformerの計算フローとテンソル構造一覧 | テンソル形状, 次元数解析, データフロー, 実装詳細, モデル内部可視化 |

| P58 | 第58回:Transformerの進化:計算量と系列長の壁を超える派生モデルたち | 効率的Attention, BigBird, Reformer, Linformer, 長文脈処理, メモリ効率化 |

| P59 | 第59回:医療時系列×Transformer:未来予測の新たな地平 | 時系列Transformer, Time Series Transformer (TST), 臨床経過予測, バイタルデータ解析 |

| P59.1 | 医療言語モデル, 臨床テキスト解析, 文脈理解, 生成AI活用 |

第VI部:高度な学習戦略と生成モデル

| ID | タイトル | 概要・キーワード |

|---|---|---|

| P61 | 第61回:深層学習の「高速道路」:ResNetとスキップ接続のイノベーション | ResNet, スキップ接続 (Skip Connection), Residual Block, 勾配消失問題対策, 深層化 |

| P61.1 | ResNet, DenseNet, 特徴量の再利用, 勾配フロー改善, アーキテクチャ比較 | |

| P62 | 第62回:モデルを安定させる「装置」:正規化層と重み初期化の重要性 | Batch Normalization, Layer Normalization, 重み初期化 (He/Xavier), 学習の安定化 |

| P63 | 第63回:学習の「ペース配分」を最適化!学習率スケジューリング入門 | 学習率 (Learning Rate), スケジューラ (Scheduler), Cosine Annealing, Warmup, 最適化戦略 |

| P64 | 第64回:生成モデル入門② VAEとGAN:潜在空間からデータを創造する | 生成モデル, VAE (変分オートエンコーダ), GAN (敵対的生成ネットワーク), 潜在空間, データ生成 |

| P65 | 第65回:拡散モデル(Diffusion Models)の衝撃!ノイズから画像を創る原理 | Diffusion Models, 拡散モデル, ノイズ除去, 画像生成AI, Stable Diffusion基礎 |

| P66 | 第66回:自己教師あり学習:ラベル無しデータからAIが「独学」する技術 | 自己教師あり学習 (SSL), ラベルなしデータ, 表現学習, マスク学習, SimCLR |

| P67 | 第67回:Vision Transformer (ViT) :画像認識をTransformerで再定義する | Vision Transformer (ViT), パッチ分割, Self-Attention, CNNとの比較, 画像認識の革新 |

| P68 | 第68回:低コストで巨大モデルを操る!LoRA(パラメータ効率的ファインチューニング) | LoRA (Low-Rank Adaptation), PEFT, ファインチューニング, 計算コスト削減, 大規模モデル適応 |

第VII部:実践開発・倫理・社会実装

| ID | タイトル | 概要・キーワード |

|---|---|---|

| P71 | 第71回:AIの「不調」を見逃さない!過学習の検出と対策の実装 | 過学習対策, EarlyStopping, データ拡張, 正則化 (L1/L2), Dropout, モデル診断 |

| P72 | 第72回:学習の成果を現場へ!モデルの保存・読み込みと推論APIの構築 | モデル保存 (.pt/.pth), 推論モード (model.eval), デプロイ, API構築, 実運用 |

| P73 | 第73回:学んだ要素を形に!医療AIミニプロジェクトの企画と実装 | 総合演習, 疾患分類, 回帰タスク, 時系列解析, 自由課題, プロジェクト開発 |

| P74 | 第74回:Zero-shot / Few-shot学習:追加学習なしでタスクを解くAIの知能 | Zero-shot Learning, Few-shot Learning, In-context Learning, 汎化能力, 小規模データ対応 |

| P75 | 第75回:最先端基盤モデルの活用:GPT-4VやMedPaLMをAPIで使いこなす | 基盤モデル (Foundation Models), GPT-4V, MedPaLM, API連携, マルチモーダルAI |

| P76 | 第76回:医療AIの社会実装と倫理:バイアス緩和と説明可能性(XAI) | AI倫理, ELSI, バイアス (Bias), 説明可能性 (XAI), SHAP, LIME, 信頼性 |

| P77 | 第77回:強化学習入門:試行錯誤から最適な医療判断を導く仕組み | 強化学習 (Reinforcement Learning), 報酬設計, エージェント, 最適化行動, 治療戦略支援 |

第VIII部:最先端フロンティア:AIの次なる革命

| ID | タイトル | 概要・キーワード |

|---|---|---|

| P81 | 第81回:推論とDeep Thinking:次世代AIの思考プロセスを解明する | Deep Thinking, Chain of Thought (CoT), 複雑な推論, 文脈理解, 推論プロセス |

| P82 | 第82回:Graph Neural Networks (GNN) 入門:分子と疾患の「ネットワーク」を捉える | Graph Neural Networks (GNN), タンパク質間相互作用, 創薬AI, グラフ構造解析 |

| P83 | 第83回:Mixture of Experts (MoE):賢くモデルを巨大化させる最新アーキテクチャ | Mixture of Experts (MoE), 専門家モデル, スパース性, 計算効率化, GPT-4アーキテクチャ |

| P84 | 第84回:大規模モデルの推論最適化:量子化と知識蒸留による高速化 | 量子化 (Quantization), 知識蒸留 (Knowledge Distillation), 軽量化, エッジAI, 高速推論 |

| P85 | 第85回:AI for Deep Research:仮説生成から科学的発見まで自動化する未来 | AI for Science, 仮説生成, 自動実験, 科学的発見, 研究DX |

| P86 | 第86回:ゲノムAIの最前線:塩基配列を「言語」として読み解く基盤モデル | ゲノム解析, DNA言語モデル, 塩基配列, 遺伝子変異予測, Bio-BERT |

| P87 | 第87回:デジタルツインと仮想患者:In Silico臨床試験による個別化医療の実現 | デジタルツイン, In Silico, 仮想臨床試験, 個別化医療, シミュレーション |

| P88 | 第88回:AIと因果推論:相関を超えて「原因」を特定する最新手法 | 因果推論 (Causal Inference), 反事実 (Counterfactual), 介入効果, 相関と因果 |

| P89 | 第89回:ワールドモデル(World Models):世界のシミュレータを内在化する次世代AI | World Models, 世界モデル, 内部シミュレーション, 強化学習, JEPA, 行動予測 |

| P90 | 第90回:量子コンピューティングと医療AI:計算のパラダイムシフトと未来展望 | 量子コンピュータ, 量子機械学習 (QML), 創薬シミュレーション, 未来展望 |

Archive

第0部:開発準備とPythonプログラミングの礎

- 第0回:P0:ゼロから始める医療AI入門講座 ― Pythonで学ぶ開発の全体像

- 第1回:P1:AnacondaとVS Codeで始める!医療AIのための開発環境構築ガイド

- 第2回:P2:初心者でもわかるPythonの基本① ― 変数とデータ型を完全マスター

- 第3回:P3:初心者でもわかるPythonの基本② ― リスト・辞書・タプルを使いこなす

- 第4回:P4:Pythonで学ぶプログラミング思考 ― if文とループで処理を自動化

- 第5回:P5:現場で役立つPython関数入門 ― 繰り返し処理をスッキリ整理

- 第6回:P6:AI開発に欠かせないオブジェクト指向 ― クラスとインスタンスの基本

- 第7回:P7:医療AIで必須!NumPy・Pandas・Matplotlibの基礎と使い方

- 第8回:P8:研究再現性のための整理術 — ファイル構造とターミナルの基礎

- 第9回:P9:医療AI研究開発のための、Git・GitHub入門! — 再現性を生む「タイムマシン」を使いこなす

- 第9.1回:P9.1:開発効率を劇的改善!Pythonデコレーターの基本と実践

第I部:ディープラーニングの数学と理論

- 第11回:P11:ニューラルネットをゼロから構築しよう!Python実装入門

- 第12回:P12:線形代数のエッセンス:ベクトル・行列・内積の直感的理解

- 第13回:P13:微分と勾配をマスター:連鎖律と勾配降下法のメカニズム

- 第14回:P14:誤差逆伝播を「計算グラフ」で攻略!視覚的に学ぶアルゴリズム

- 第15回:P15:ディープラーニングの心臓部:誤差逆伝播と自動微分の真髄

第II部:PyTorchフレームワーク:実装の作法

- 第21回:P21:PyTorch入門:Tensor操作と自動微分の基本

└ torch.Tensor, .backward(), .grad の使い方 - 第22回:P22:PyTorchでモデルを定義!nn.Moduleの構造を理解する

└ nn.Module によるモデル構築, forward()メソッド - 第23回:P23:損失関数と最適化:MSE・CrossEntropy・SGD・Adamの使い分け

- 第24回:P24:モデルに「個性」と「規律」を!活性化関数と正則化による精度向上

- 第25回:P25:大量データを効率よく学習!ミニバッチ学習とDataLoader自作術

- 第26回:P26:AIモデルの「健康診断」:学習の可視化と評価指標の選び方

- 第27回:P27:初めての総合演習!多層ニューラルネットで疾患予測に挑戦

└ データ前処理, 訓練, 検証, 汎化性能のチェック

第III部:コンピュータビジョン:医療画像解析の深化

- 第31回:P31:PyTorchで画像処理!医療画像分類への第一歩

└ 画像認識タスクの導入(MNISTやCIFARなど)- 第31.1回:P31.1:画像データの基礎とTorchVisionによる前処理テクニック

└ torchvision.transforms, 正規化, テンソル変換

- 第31.1回:P31.1:画像データの基礎とTorchVisionによる前処理テクニック

- 第32回:P32:畳み込みニューラルネットワーク(CNN)の理論と実装

└ 畳み込み層, プーリング層, 基本部品の実装 - 第33回:P33:実践!PyTorchでCNNモデルを訓練する(MNIST編)

└ パイプライン構築, 学習, 評価指標 - 第34回:P34:データ拡張(Data Augmentation)で過学習を防ぐ

└ 回転・反転による汎化性能向上 - 第35回:P35:カラー画像への挑戦!CIFAR-10による高度な分類

└ 3チャネルデータの扱い, 実践的課題 - 第36回:P36:CNNのブラックボックスを覗く:特徴マップの可視化

└ 判断根拠の解釈性を高める手法 - 第37回:P37:最強の武器「学習済みモデル」!転移学習とファインチューニング

└ torchvision.models, ResNetの活用 - 第38回:P38:医療AI実践:PyTorchを用いた実戦的医療画像分類

└ 限られたデータでのモデル訓練 - 第39回:P39:画像認識の最前線へ:物体検出・セグメンテーションの展望

└ 領域分割, 検出アルゴリズムの基礎

第IV部:シーケンス解析:時系列データと医療自然言語

- 第41回:P41:AIに「時間」を教える:RNN/LSTMによる系列データ分析

└ 文字列生成, 時系列予測の応用 - 第42回:P42:再帰型ニューラルネット(RNN)の理論とPyTorch実装

- 第43回:P43:医療時系列データをRNNで読み解く!バイタル予測の実践

- 第44回:P44:医療自然言語処理入門!RNNによるテキスト解析の基礎

- 第45回:P45:長期記憶の魔法!LSTMの理論とPyTorch実装徹底解説

- 第46回:P46:医療時系列×LSTM:高度な予後予測モデルの構築

- 第47回:P47:医療NLP×LSTM:電子カルテデータの文脈を捉える

- 第48回:P48:GRU(Gated Recurrent Unit)による効率的な系列モデルの実装

- 第49回:P49:系列モデルの学習テクニックと医療応用における発展的話題

第V部:Attention & Transformer:現代AIの核心

- 第51回:P51:ChatGPTを支える「Transformer」徹底理解!自己回帰生成の全貌

- 第52回:P52:Transformerの学習戦略:事前学習とファインチューニングの極意

└ Next Token Prediction, 自己教師あり学習, 損失関数 - 第53回:P53:Transformerのアーキテクチャ解剖:Self-Attentionから正規化まで

└ Multi-Head Attention, FFN, 残差接続, Positional Encoding - 第54回:P54:Attentionは「何を見ているのか?」クエリ・キー・バリューの仕組み

└ Q/K/V計算, 重みの可視化, マスク処理 - 第55回:P55:FFN(Feed Forward Network)の重要性:意味を深化させる非線形変換

└ 2層MLPの意義, 抽象化のメカニズム - 第56回:P56:Decoderモデルにおける出力生成:logitsからサンプリングまで

└ Softmax, 自己回帰生成, パラメータ共有- 第56.1回:P56.1:残差接続とLayerNorm:モデルの安定性と表現力の両立

└ 勾配流の安定化設計, 正規化の意義 - 第56.2回:P56.2:Transformerの限界と未来:意味理解と派生モデルの展望

└ Longformer, 計算量の課題, 医療応用への可能性

- 第56.1回:P56.1:残差接続とLayerNorm:モデルの安定性と表現力の両立

- 第57回:P57:徹底解剖!Transformerの計算フローとテンソル構造一覧

- 第58回:P58:Transformerの進化:計算量と系列長の壁を超える派生モデルたち

└ BigBird, Reformer, 効率的Attention機構 - 第59回:P59:医療時系列×Transformer:未来予測の新たな地平

第VI部:高度な学習戦略と生成モデル

- 第61回:P61:深層学習の「高速道路」:ResNetとスキップ接続のイノベーション

- 第62回:P62:モデルを安定させる「装置」:正規化層と重み初期化の重要性

- 第63回:P63:学習の「ペース配分」を最適化!学習率スケジューリング入門

- 第64回:P64:生成モデル入門② VAEとGAN:潜在空間からデータを創造する

- 第65回:P65:拡散モデル(Diffusion Models)の衝撃!ノイズから画像を創る原理

- 第66回:P66:自己教師あり学習:ラベル無しデータからAIが「独学」する技術

- 第67回:P67:Vision Transformer (ViT) :画像認識をTransformerで再定義する

- 第68回:P68:低コストで巨大モデルを操る!LoRA(パラメータ効率的ファインチューニング)

第VII部:実践開発・倫理・社会実装

- 第71回:P71:AIの「不調」を見逃さない!過学習の検出と対策の実装

└ EarlyStopping, データ拡張, 正則化 - 第72回:P72:学習の成果を現場へ!モデルの保存・読み込みと推論APIの構築

└ .pt/.pthファイル, model.eval(), 推論デプロイ基礎 - 第73回:P73:学んだ要素を形に!医療AIミニプロジェクトの企画と実装

└ 疾患分類, 回帰, 時系列などの自由課題演習 - 第74回:P74:Zero-shot / Few-shot学習:追加学習なしでタスクを解くAIの知能

- 第75回:P75:最先端基盤モデルの活用:GPT-4VやMedPaLMをAPIで使いこなす

- 第76回:P76:医療AIの社会実装と倫理:バイアス緩和と説明可能性(XAI)

└ ELSI, SHAP, LIMEによる根拠の可視化 - 第77回:P77:強化学習入門:試行錯誤から最適な医療判断を導く仕組み

第VIII部:最先端フロンティア:AIの次なる革命

- 第81回:P81:推論とDeep Thinking:次世代AIの思考プロセスを解明する

└ 深い文脈理解, 連鎖的推論のモデリング - 第82回:P82:Graph Neural Networks (GNN) 入門:分子と疾患の「ネットワーク」を捉える

└ タンパク質間相互作用, 遺伝子グラフの解析 - 第83回:P83:Mixture of Experts (MoE):賢くモデルを巨大化させる最新アーキテクチャ

- 第84回:P84:大規模モデルの推論最適化:量子化と知識蒸留による高速化

- 第85回:P85:AI for Deep Research:仮説生成から科学的発見まで自動化する未来

- 第86回:P86:ゲノムAIの最前線:塩基配列を「言語」として読み解く基盤モデル

- 第87回:P87:デジタルツインと仮想患者:In Silico臨床試験による個別化医療の実現

- 第88回:P88:AIと因果推論:相関を超えて「原因」を特定する最新手法

- 第89回:ワールドモデル(World Models):世界のシミュレータを内在化する次世代AI

- 第90回:P90:量子コンピューティングと医療AI:計算のパラダイムシフトと未来展望

ご利用規約(免責事項)

当サイト(以下「本サイト」といいます)をご利用になる前に、本ご利用規約(以下「本規約」といいます)をよくお読みください。本サイトを利用された時点で、利用者は本規約の全ての条項に同意したものとみなします。

第1条(目的と情報の性質)

- 本サイトは、医療分野におけるAI技術に関する一般的な情報提供および技術的な学習機会の提供を唯一の目的とします。

- 本サイトで提供されるすべてのコンテンツ(文章、図表、コード、データセットの紹介等を含みますが、これらに限定されません)は、一般的な学習参考用であり、いかなる場合も医学的な助言、診断、治療、またはこれらに準ずる行為(以下「医行為等」といいます)を提供するものではありません。

- 本サイトのコンテンツは、特定の製品、技術、または治療法の有効性、安全性を保証、推奨、または広告・販売促進するものではありません。紹介する技術には研究開発段階のものが含まれており、その臨床応用には、さらなる研究と国内外の規制当局による正式な承認が別途必要です。

- 本サイトは、情報提供を目的としたものであり、特定の治療法を推奨するものではありません。健康に関するご懸念やご相談は、必ず専門の医療機関にご相談ください。

第2条(法令等の遵守)

利用者は、本サイトの利用にあたり、医師法、医薬品、医療機器等の品質、有効性及び安全性の確保等に関する法律(薬機法)、個人情報の保護に関する法律、医療法、医療広告ガイドライン、その他関連する国内外の全ての法令、条例、規則、および各省庁・学会等が定める最新のガイドライン等を、自らの責任において遵守するものとします。これらの適用判断についても、利用者が自ら関係各所に確認するものとし、本サイトは一切の責任を負いません。

第3条(医療行為における責任)

- 本サイトで紹介するAI技術・手法は、あくまで研究段階の技術的解説であり、実際の臨床現場での診断・治療を代替、補助、または推奨するものでは一切ありません。

- 医行為等に関する最終的な判断、決定、およびそれに伴う一切の責任は、必ず法律上その資格を認められた医療専門家(医師、歯科医師等)が負うものとします。AIによる出力を、資格を有する専門家による独立した検証および判断を経ずに利用することを固く禁じます。

- 本サイトの情報に基づくいかなる行為によって利用者または第三者に損害が生じた場合も、本サイト運営者は一切の責任を負いません。実際の臨床判断に際しては、必ず担当の医療専門家にご相談ください。本サイトの利用によって、利用者と本サイト運営者の間に、医師と患者の関係、またはその他いかなる専門的な関係も成立するものではありません。

第4条(情報の正確性・完全性・有用性)

- 本サイトは、掲載する情報(数値、事例、ソースコード、ライブラリのバージョン等)の正確性、完全性、網羅性、有用性、特定目的への適合性、その他一切の事項について、何ら保証するものではありません。

- 掲載情報は執筆時点のものであり、予告なく変更または削除されることがあります。また、技術の進展、ライブラリの更新等により、情報は古くなる可能性があります。利用者は、必ず自身で公式ドキュメント等の最新情報を確認し、自らの責任で情報を利用するものとします。

第5条(AI生成コンテンツに関する注意事項)

本サイトのコンテンツには、AIによる提案を基に作成された部分が含まれる場合がありますが、公開にあたっては人間による監修・編集を経ています。利用者が生成AI等を用いる際は、ハルシネーション(事実に基づかない情報の生成)やバイアスのリスクが内在することを十分に理解し、その出力を鵜呑みにすることなく、必ず専門家による検証を行うものとします。

第6条(知的財産権)

- 本サイトを構成するすべてのコンテンツに関する著作権、商標権、その他一切の知的財産権は、本サイト運営者または正当な権利を有する第三者に帰属します。

- 本サイトのコンテンツを引用、転載、複製、改変、その他の二次利用を行う場合は、著作権法その他関連法規を遵守し、必ず出典を明記するとともに、権利者の許諾を得るなど、適切な手続きを自らの責任で行うものとします。

第7条(プライバシー・倫理)

本サイトで紹介または言及されるデータセット等を利用する場合、利用者は当該データセットに付随するライセンス条件および研究倫理指針を厳格に遵守し、個人情報の匿名化や同意取得の確認など、適用される法規制に基づき必要とされるすべての措置を、自らの責任において講じるものとします。

第8条(利用環境)

本サイトで紹介するソースコードやライブラリは、執筆時点で特定のバージョンおよび実行環境(OS、ハードウェア、依存パッケージ等)を前提としています。利用者の環境における動作を保証するものではなく、互換性の問題等に起因するいかなる不利益・損害についても、本サイト運営者は責任を負いません。

第9条(免責事項)

- 本サイト運営者は、利用者が本サイトを利用したこと、または利用できなかったことによって生じる一切の損害(直接損害、間接損害、付随的損害、特別損害、懲罰的損害、逸失利益、データの消失、プログラムの毀損等を含みますが、これらに限定されません)について、その原因の如何を問わず、一切の法的責任を負わないものとします。

- 本サイトの利用は、学習および研究目的に限定されるものとし、それ以外の目的での利用はご遠慮ください。

- 本サイトの利用に関連して、利用者と第三者との間で紛争が生じた場合、利用者は自らの費用と責任においてこれを解決するものとし、本サイト運営者に一切の迷惑または損害を与えないものとします。

- 本サイト運営者は、いつでも予告なく本サイトの運営を中断、中止、または内容を変更できるものとし、これによって利用者に生じたいかなる損害についても責任を負いません。

第10条(規約の変更)

本サイト運営者は、必要と判断した場合、利用者の承諾を得ることなく、いつでも本規約を変更することができます。変更後の規約は、本サイト上に掲載された時点で効力を生じるものとし、利用者は変更後の規約に拘束されるものとします。

第11条(準拠法および合意管轄)

本規約の解釈にあたっては、日本法を準拠法とします。本サイトの利用および本規約に関連して生じる一切の紛争については、東京地方裁判所を第一審の専属的合意管轄裁判所とします。

For J³, may joy follow you.